Le système d’exploitation IBM

Dans les années 1970, IBM dominait le marché des mainframes – les gros systèmes – avec sa série 360. Mais il fut battu par DEC et par Wang sur le marché des mini-ordinateurs de la taille d’un réfrigérateur, et il semblait bien qu’IBM allait être également largué sur le marché des ordinateurs individuels. « Si IBM sortait un ordinateur individuel, ce serait comme si on apprenait les claquettes à un éléphant », déclara un expert89.

La direction de la société était apparemment d’accord. Elle envisagea donc à la place de vendre sous licence l’ordinateur de salon Atari 800 en collant dessus l’étiquette IBM. Mais quand ce choix fut l’objet d’une réunion en juillet 1980, le directeur général d’IBM Frank Carey y mit son veto. La première entreprise d’informatique mondiale, dit-il, devait sûrement pouvoir créer un ordinateur personnel toute seule. Il déplora que la mise au point de la moindre nouveauté chez IBM exige apparemment trois cents personnes travaillant pendant trois ans.

C’est alors que Bill Lowe, directeur du laboratoire de développement IBM à Boca Raton, en Floride, se risqua à dire : « Non, vous vous trompez, monsieur le directeur. Nous pouvons faire aboutir un projet en un an90. » Son culot lui valut d’être chargé de superviser le projet de création d’un ordinateur personnel IBM, dont le nom de code « Acorn » évoquait le fruit du chêne.

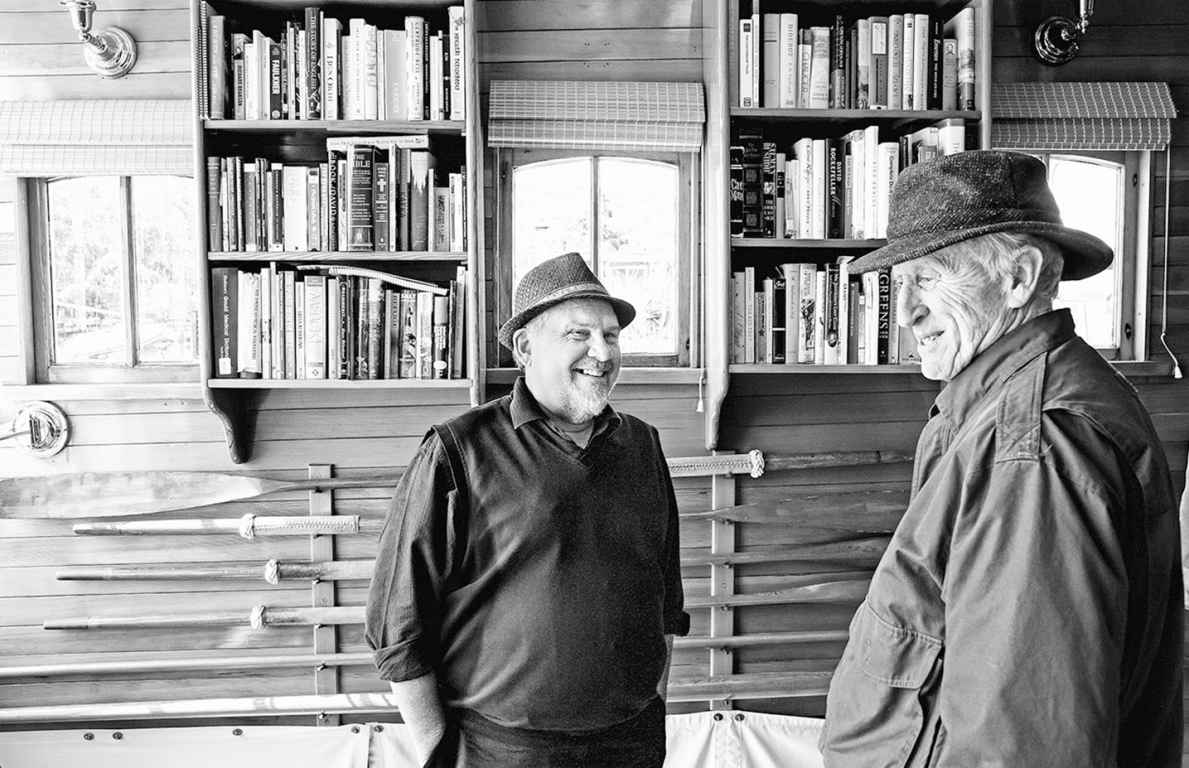

La nouvelle équipe de Bill Lowe était dirigée par Don Estridge, qui chargea Jack Sams, un aimable Sudiste avec vingt ans d’ancienneté chez IBM, d’élaborer le logiciel. Vu la brièveté du délai d’un an, il savait qu’il serait obligé d’exploiter sous licence des logiciels de source externe au lieu de les faire rédiger en interne. Le 21 juillet 1980, il téléphona à Bill Gates et lui demanda un rendez-vous de toute urgence. Lorsque Gates l’invita à prendre l’avion pour Seattle la semaine suivante, Sams répondit qu’il était déjà sur le chemin de l’aéroport et qu’il voulait voir Gates le lendemain. Détectant un gros poisson impatient de mordre à l’hameçon, Gates en fut tout émoustillé.

Quelques semaines plus tôt, il avait recruté son voisin de palier à Harvard, Steve Ballmer, comme directeur commercial de Microsoft. Il lui demanda donc de l’accompagner à la réunion avec les gens d’IBM. « Tu es le seul autre mec ici qui puisses porter un costard », lui fit remarquer Gates91. Quand Sams arriva, Gates portait lui aussi un costume, mais avait du mal à le remplir. « Quand ce jeune homme est sorti pour nous montrer le chemin, je l’ai pris pour le garçon de bureau », raconte Sams, qui avait revêtu l’uniforme IBM – complet bleu et chemise blanche. Mais lui-même et le reste de son équipe furent bientôt éblouis par l’intelligence de Gates.

Au début, les gens de chez IBM voulaient parler de l’exploitation sous licence du Microsoft BASIC, mais Gates orienta la conversation vers une discussion animée sur la direction que prenait la technologie. Au bout de quelques heures, ils envisageaient d’exploiter sous licence tous les langages de programmation que Microsoft avait produits ou pourrait produire, dont le Fortran et le COBOL, en plus du BASIC. « Nous avons dit à IBM : “O.K., vous pouvez avoir tout ce que nous faisons”, alors même que nous ne l’avions pas encore fait », raconte Gates92.

L’équipe d’IBM revint quelques semaines plus tard. En plus de ces langages de programmation, il manquait à IBM un logiciel essentiel. Il fallait un système d’exploitation, le logiciel sur lequel seraient fondés tous les autres programmes. Un système d’exploitation se charge des instructions de base utilisées par les autres logiciels, pour des tâches telles que décider où stocker les données, comment allouer l’espace mémoire et les ressources en matière de traitement, et déterminer comment les logiciels des applications interagissent avec la partie matériel de l’ordinateur.

Microsoft n’avait pas encore de système d’exploitation maison. Au lieu de quoi il utilisait le CP/M (pour Control Program for Microprocessors), qui était la propriété de Gary Kildall, un ami d’enfance de Gates récemment installé à Monterey, en Californie. Alors, sous les yeux de Sams assis dans son bureau, Gates décrocha son téléphone et appela Kildall. « Je vais t’envoyer des mecs, dit-il en décrivant ce que cherchaient les cadres de chez IBM. Tu t’occupes bien d’eux, ce sont des mecs importants93. »

Kildall ne le fit pas. Gates parlerait plus tard du « jour où Gary a décidé de faire de l’avion ». Au lieu de rencontrer les émissaires d’IBM, Kildall choisit de piloter son avion personnel, ce qu’il adorait faire, et de ne pas décommander un rendez-vous à San Francisco déjà prévu. Il chargea son épouse de rencontrer les quatre hommes en complet sombre d’IBM dans l’excentrique maison victorienne qui tenait lieu de siège à sa société. Quand ils lui présentèrent un copieux accord de non-divulgation, elle refusa de le signer. Après avoir palabré longtemps, les gens d’IBM repartirent, dégoûtés. « On lui a mis sous le nez la lettre habituelle, comme quoi elle ne devait dire à personne que nous étions ici et nous ne voulions pas entendre quoi que ce soit de confidentiel ; elle l’a lue et a dit : “Je ne peux pas signer ça”, raconte Sams. Nous avons passé toute la journée à Pacific Grove à discuter avec eux, et avec nos juristes et leurs juristes et un peu tout le monde pour savoir si oui ou non elle pourrait ne serait-ce que mentionner devant nous le fait qu’elle nous parlait, et puis nous sommes partis. » La modeste société de Gary Kildall venait de laisser passer sa chance de devenir l’acteur principal dans l’industrie du logiciel informatique94.

Sams reprit l’avion pour voir Gates à Seattle et lui demanda de trouver un autre moyen de créer un système d’exploitation à partir de zéro. Par bonheur, Paul Allen connaissait quelqu’un à Seattle qui pourrait les aider : Tim Paterson, qui travaillait pour une petite entreprise appelée Seattle Computer Products. Quelques mois plus tôt, Paterson, frustré de voir que le CP/M de Kildall n’était pas disponible pour les tout derniers microprocesseurs de chez Intel, l’avait adapté pour en faire un système d’exploitation qu’il appela QDOS, pour Quick and Dirty Operating System (« système d’exploitation vite et mal fait »)95.

À cette date, Gates avait déjà pris conscience qu’un système d’exploitation unique, très vraisemblablement celui choisi par IBM, finirait par être le système standard qu’adopteraient la plupart des ordinateurs individuels. Il comprit aussi que quiconque posséderait ce système d’exploitation serait dans une position plus qu’avantageuse. Au lieu d’envoyer les gens d’IBM chez Paterson, Gates et son équipe dirent qu’ils se débrouilleraient tout seuls. « Nous avons simplement dit à IBM : “Écoutez, on va récupérer ce système d’exploitation chez cette petite boîte locale, on s’en occupe et on le retape” », raconterait plus tard Ballmer.

L’entreprise de Paterson se démenait pour joindre les deux bouts, aussi Allen fut-il en mesure de négocier astucieusement un accord avec son ami. Après avoir initialement acquis une licence non exclusive, Allen retourna le voir lorsqu’un accord avec IBM sembla probable et racheta carrément le logiciel à Paterson sans lui dire pourquoi. « Nous avons finalement trouvé un accord pour lui acheter le système d’exploitation avec toute liberté quant à son utilisation, et ce pour cinquante mille dollars », raconte Allen96. Pour cette somme dérisoire, Microsoft entra en possession du logiciel qui, une fois toiletté par ses soins, lui permettrait de dominer l’industrie du logiciel pendant plus de trois décennies.

Mais Gates faillit reculer. Il s’inquiéta – une fois n’est pas coutume – de ce que Microsoft, engagé au-delà du raisonnable dans d’autres projets, ne puisse avoir la capacité de mettre le QDOS à niveau pour en faire un système d’exploitation digne d’IBM. Microsoft n’avait qu’un personnel hétéroclite de quarante employés, dont certains dormaient par terre et faisaient leur toilette matinale à l’éponge, et était dirigé par un individu de vingt-quatre ans qu’on pouvait encore prendre pour un garçon de bureau. Un lundi, fin septembre 1980, deux mois après la première visite des cadres IBM, Gates réunit son état-major pour prendre la décision : on y va ou on n’y va pas ? Kay Nishi, un jeune entrepreneur japonais doté d’une conviction toute gatésienne, était le plus intransigeant : « Faut y aller ! Faut y aller ! » hurlait-il en trépignant d’un bout à l’autre la pièce. Gates décida qu’il avait raison97.

Gates et Ballmer prirent un vol de nuit pour Boca Raton afin de négocier avec IBM. Leurs revenus de 1980 s’élevaient à 7,5 millions de dollars, contre 30 milliards de dollars chez IBM, mais Gates visait un accord qui autoriserait Microsoft à conserver la propriété d’un système d’exploitation dont IBM ferait un standard international. Dans le marché passé avec la société de Tim Paterson, Microsoft avait acheté comptant QDOS « pour quelque usage que ce soit », au lieu de se contenter d’une licence d’exploitation. C’était intelligent, mais il serait encore plus intelligent de ne pas laisser IBM imposer à Microsoft le même arrangement.

En arrivant à l’aéroport de Miami, ils allèrent dans les toilettes se changer et Gates se rendit compte qu’il avait oublié sa cravate. Dans une manifestation inhabituelle de méticulosité, il tint à ce qu’ils fassent étape sur la route de Boca Raton dans un magasin de la chaîne Burdine’s pour en acheter une. Elle ne produisit pas vraiment l’effet escompté sur les cadres IBM tirés à quatre épingles qui accueillirent Gates. L’un des ingénieurs logiciel se rappela qu’il ressemblait à « un môme qui aurait coursé quelqu’un autour du bloc pour lui piquer son costard, qui était beaucoup trop grand pour lui. Avec son col qui dépassait, il avait l’air d’un petit voyou, et j’ai dit : “Mais qui c’est, celui-là98 ?” »

Toutefois, dès que Gates eut commencé sa présentation, ils cessèrent de se concentrer sur sa tenue débraillée. Il subjugua l’équipe IBM par sa maîtrise des détails, aussi bien techniques que juridiques, et projeta une impression de calme assurance en insistant sur les termes de l’accord. Mais c’était du cinéma, à peu de chose près. Quand il rentra à Seattle, Gates alla dans son bureau, se coucha par terre et exprima tout haut devant Ballmer ses multiples doutes et angoisses.

Au bout d’un mois de va-et-vient, un accord de trente-deux pages fut finalisé début novembre 1980. « Steve et moi connaissions ce contrat par cœur, déclare Gates99. Nous n’avons pas gagné tant que ça dans cette affaire. Quelque chose comme cent quatre-vingt-six mille dollars en tout. » Du moins au début. Mais le contrat comportait les deux clauses dont Gates savait qu’elles modifieraient l’équilibre du pouvoir dans l’industrie de l’informatique. La première était que la licence qu’aurait IBM d’utiliser le système d’exploitation, baptisé PC-DOS, ne comporterait pas l’exclusivité. Gates pourrait proposer l’exploitation sous licence du même système, sous le nom de MS-DOS, à d’autres fabricants d’ordinateurs. La seconde était que Microsoft demeurerait propriétaire du code source. Cela signifiait qu’IBM ne pourrait modifier ni actualiser le logiciel pour en faire quelque chose d’exclusif à ses ordinateurs. Seul Microsoft pourrait opérer des changements et ensuite en proposer la licence d’exploitation à toutes les sociétés qu’il voudrait. « Nous savions qu’il y allait avoir des clones de l’IBM PC, explique Gates. Nous avons structuré le contrat initial afin de permettre leur existence. C’était un point capital de nos négociations100. »

Cet accord était similaire à celui que Gates avait conclu avec MITS, lorsqu’il avait conservé le droit de proposer l’exploitation sous licence du BASIC à d’autres fabricants d’ordinateurs. Cette clause permit au BASIC de Microsoft et ensuite, plus important encore, à son système d’exploitation de devenir la norme en informatique, norme contrôlée par Microsoft. « En fait, le slogan de notre pub était à l’origine “Nous fixons la norme”, raconte Gates en riant. Mais quand nous avons effectivement fixé la norme, notre juriste antitrust nous a dit de le supprimer. C’est un de ces slogans qu’on ne peut utiliser que s’ils sont mensongers*4101. »

Gates se vanta auprès de sa mère de l’importance de son accord avec IBM dans l’espoir de prouver qu’il avait eu raison de décrocher de Harvard. Or Mary Gates siégeait au conseil d’administration de la fondation caritative United Way avec le président d’IBM, John Opel, qui allait remplacer Frank Cary comme directeur général. Un jour qu’elle se rendait à une réunion avec Opel dans l’avion personnel de ce dernier, elle évoqua le rapport entre Gates et IBM : « Oh, mon fils est en plein dans un projet. En fait, il travaille pour votre société. » Apparemment, Opel ignorait l’existence de Microsoft. Quand elle rentra, elle avertit donc Bill : « Écoute, j’ai parlé de ton projet à Opel, j’ai dit que tu avais quitté la fac, et tout le reste, et il ne sait pas qui tu es, alors peut-être que ton projet n’est pas aussi important que tu le crois. » Quelques semaines plus tard, les cadres de Boca Raton se rendirent au siège d’IBM pour faire leur rapport à Opel. « Nous sommes dépendants d’Intel pour la puce, Sears et Computer Land vont assurer la distribution, expliqua le chef de l’équipe. Mais le fournisseur dont nous dépendons le plus est en fait une toute petite maison d’édition de logiciels basée à Seattle et dirigée par un certain Bill Gates. » Ce à quoi Opel répondit : « Oh, vous voulez dire le fils de Mary Gates ? Ouais, elle est super102. »

Comme Gates l’avait prédit, produire tous les logiciels pour IBM ne fut pas une partie de plaisir, mais l’équipe hétéroclite de Microsoft travailla vingt-quatre heures sur vingt-quatre pendant neuf mois pour y parvenir. Gates et Allen œuvrèrent pour une dernière fois en binôme, assis côte à côte, programmant tout la nuit avec l’intensité partagée dont ils avaient fait preuve à Lakeside et à Harvard. « Le seul différend que Paul et moi ayons eu, c’est quand lui voulait voir le lancement de la navette spatiale, et moi pas parce que nous étions en retard », raconte Gates. Finalement, Allen fit le voyage. « C’était la première navette, dit-il. Et nous avons repris l’avion juste après le lancement. Nous ne sommes même pas restés absents trente-six heures. »

En rédigeant le logiciel du système d’exploitation, ils contribuèrent à déterminer l’aspect et la maniabilité de l’ordinateur personnel. « Paul et moi avons décidé de tous les moindres détails du PC, raconte Gates. La disposition des touches du clavier, la manière dont fonctionnaient le port cassette, le port audio, le port graphique103. » Le résultat refléta hélas les goûts nerdiques de Gates en matière de design et d’ergonomie. À part le fait qu’elles obligeaient une cohorte d’utilisateurs à apprendre où se trouvait la touche antislash, on ne pouvait dire beaucoup de bien d’interfaces humain/machine qui comptaient sur des messages du type « c :\> » et des noms de fichiers tels que AUTOEXEC.BAT et CONFIG.SYS.

Des années plus tard, lors d’une réception à Harvard, l’investisseur en actions David Rubenstein demanda à Gates pourquoi il avait encombré le monde avec la séquence de démarrage CTRL+ALT+SUPP : « Dites-moi, quand je veux démarrer mon application et mon ordinateur, pourquoi est-ce que j’ai besoin de trois doigts ? Qui a eu cette idée ? » Gates commença à expliquer que les concepteurs du clavier de chez IBM n’avaient pas réussi à trouver une manière facile d’indiquer à la machine de lancer le système d’exploitation, puis il s’interrompit et sourit d’un air penaud. « C’était une erreur », avoua-t-il104. Les programmeurs purs et durs oublient parfois que la simplicité est l’âme de la beauté.

L’IMB PC fut dévoilé, avec un prix public de 1 565 dollars, au Waldorf Astoria de New York en août 1981. Gates et son équipe ne furent pas invités à la cérémonie. « Le truc le plus bizarre, raconte Gates, c’est que lorsque nous avons demandé d’assister au grand lancement officiel, IBM nous a opposé un refus105. » Dans l’esprit d’IBM, Microsoft n’était qu’un simple fournisseur.

Rira bien qui rira le dernier. Grâce au marché qu’il avait passé, Microsoft put transformer l’IBM PC et ses clones en des marchandises interchangeables qui en seraient réduites à casser leurs prix pour être compétitives et seraient condamnées à dégager des marges bénéficiaires minuscules. Dans une interview qui parut dans le magazine PC quelques mois plus tard, Gates fit remarquer que tous les ordinateurs individuels utiliseraient bientôt les mêmes microprocesseurs standardisés : « Le matériel deviendra beaucoup moins intéressant. Tout l’enjeu résidera dans le logiciel106. »

L’interface graphique

Steve Jobs et son équipe de chez Apple achetèrent un IBM PC neuf dès qu’il sortit. Ils voulaient voir à quoi ressemblait la concurrence. L’opinion unanime, pour reprendre l’expression de Jobs, fut que « ça craignait ». Cela ne reflétait pas simplement l’arrogance instinctive de Job, bien qu’elle soit présente. C’était une réaction au fait que la machine, avec ses messages rébarbatifs du genre « c :\> » et ses formes anguleuses, n’avait rien d’excitant. Il ne vint pas à l’esprit de Jobs que les cadres et gestionnaires d’entreprises technologiques puissent ne pas rechercher de quoi mettre de l’ambiance au bureau et sachent qu’ils n’auraient pas d’ennuis s’ils préféraient une marque ennuyeuse comme IBM à une marque audacieuse comme Apple. Bill Gates se trouvait par hasard au siège d’Apple pour une réunion le jour où l’IBM PC fut annoncé. « Apparemment, ça ne les intéressait pas, raconte Gates. Ils ont mis un an pour prendre conscience de ce qui s’était passé107. »

Jobs était excité par la concurrence, surtout quand il la trouvait nulle. Il se voyait comme un guerrier zen éclairé combattant les forces du mal et de la laideur. Il fit insérer dans le Wall Street Journal un placard qu’il aida à rédiger. La manchette : « Bienvenue, IBM. Sérieusement. »

L’une des raisons du mépris de Jobs était qu’il avait déjà vu l’avenir et qu’il tenait à l’inventer. Lors de ses visites au Xerox PARC, on lui montra nombre des idées qu’Alan Kay, Doug Engelbart et leurs collègues avaient développées, et, par-dessus tout, l’interface graphique utilisateur (GUI prononcé « gou-i » pour Graphic User Interface), qui présentait un bureau virtuel avec des fenêtres, des icônes, et une souris pour déplacer le curseur. La créativité du Xerox PARC combinée au génie de Jobs en matière d’esthétique fonctionnelle et de marketing ferait de l’interface graphique le prochain grand bond en avant qui faciliterait l’interaction humain-machine envisagée par Bush, Licklider et Englebart.

Les deux principales visites de Jobs et de son équipe au Xerox PARC eurent lieu en décembre 1979. Jef Raskin, un ingénieur Apple qui concevait un ordinateur convivial – le futur Macintosh –, avait déjà vu ce que faisait Xerox et voulait convaincre Jobs d’y jeter un coup d’œil. Seulement Jobs trouvait Raskin insupportable – la terminologie technique qu’il utilisait pour le décrire était « un trouduc qui craint » –, mais il finit par faire le pèlerinage à Pasadena. Il avait conclu un marché avec Xerox qui autorisait les gens d’Apple à étudier la technologie maison ; en contrepartie, il autorisait Xerox à investir un million de dollars dans Apple.

Jobs n’était certainement pas la première personnalité extérieure à voir les productions du Xerox PARC. Les chercheurs du PARC avaient fait des centaines de démonstrations au profit des visiteurs, et avaient déjà distribué plus d’un millier de Xerox Alto, le coûteux ordinateur développé par Lampson, Thacker et Kay et qui utilisait une interface graphique et d’autres innovations du PARC. Mais Jobs fut le premier à être obsédé par l’intégration des interfaces suggérées par le PARC à un ordinateur individuel simple et bon marché. Une fois de plus, l’innovation capitale ne viendrait pas des gens qui avaient créé la percée, mais des gens qui l’avaient judicieusement appliquée.

Lors de la première visite de Jobs, les ingénieurs du Xerox PARC, conduits par Adele Goldberg, qui travaillait avec Alan Kay, étaient sur la défensive. Ils ne lui montrèrent pas grand-chose. Mais il piqua une crise – « Arrêtez ces conneries ! » répétait-il – et eut finalement droit, à la demande de la direction de Xerox, à une présentation plus complète. Jobs ne tenait pas en place tandis que ses ingénieurs examinaient chaque pixel de l’écran. « Vous êtes assis sur une mine d’or ! cria-t-il. Je ne peux pas croire que Xerox ne veuille pas en profiter. »

Trois innovations majeures étaient présentées. La première était Ethernet, technologie développée par Bob Metcalfe pour créer des réseaux locaux. Comme Gates et d’autres pionniers de l’ordinateur individuel, Jobs ne s’intéressait pas beaucoup – certainement pas autant qu’il l’aurait dû – à la technologie du réseautage. Il se concentrait sur la capacité des ordinateurs à émanciper les individus plutôt qu’à faciliter la collaboration. La deuxième innovation était la programmation orientée objet. Cela ne captiva pas non plus Jobs, qui n’était pas un programmeur.

En revanche, son attention fut attirée par l’interface graphique et son bureau virtuel aussi intuitif et convivial qu’une aire de jeu au coin de la rue : de mignons pictogrammes (les « icônes ») pour les fichiers et les dossiers, et d’autres choses utiles, comme une corbeille, et un curseur contrôlé par une souris qui permettait de cliquer facilement dessus. Jobs non seulement adora ce système, mais il voyait déjà comment l’améliorer, le rendre plus simple et plus élégant.

L’interface graphique avait été rendue possible par l’affichage matriciel (bitmapping), autre innovation introduite au Xerox PARC. Jusque-là, la plupart des ordinateurs, y compris l’Apple II, se contentaient de générer à l’écran des caractères alphanumériques (chiffres et/ou lettres), habituellement dans un affreux vert sur fond noir. L’affichage bitmap permettait à l’ordinateur de contrôler individuellement chaque pixel sur l’écran – l’allumer ou l’éteindre et en changer la couleur à volonté. Ce qui autorisait toutes sortes d’affichages, de polices de caractères, de motifs et de graphismes. Avec son sens du design, sa connaissance des polices de caractères et son amour de la calligraphie, Jobs fut emballé par l’affichage bitmap : « C’était comme si on m’avait retiré un voile des yeux. Je voyais ce que serait l’avenir de l’informatique. »

Lorsque Jobs rentra à Cupertino au volant de sa voiture, à une vitesse qui aurait forcé même un Bill Gates au respect, il annonça à son collègue Bill Atkinson qu’il leur faudrait incorporer – en l’améliorant – l’interface graphique Xerox dans les futurs ordinateurs Apple, tels que les Lisa et Macintosh dont la sortie était imminente. « Mais bien sûr ! s’écria-t-il. C’est ça ! C’est ça qu’on doit faire ! » C’était un moyen de mettre l’informatique au service de tout le monde108.

Plus tard, quand on lui reprocha d’avoir pillé les idées de Xerox, Jobs cita Picasso : « Les bons artistes copient, les grands artistes volent. » Et il ajouta : « Nous n’avons jamais eu honte de piquer des bonnes idées. » Il proclama aussi que les dirigeants de Xerox auraient eux-mêmes mis leur création sur la voie de garage : « C’étaient des maniaques de la photocopie qui n’avaient pas la moindre idée de ce que pourrait faire un ordinateur. Ils ont carrément transformé en défaite l’une des plus grandes victoires de l’informatique. Xerox aurait pu avoir toute l’industrie dans sa poche109. »

En fait, aucune de ces explications ne rend justice à Jobs et à Apple. Comme dans le cas de l’inventeur oublié de l’Iowa John Atanasoff, la conception n’est qu’une première étape. Ce qui compte vraiment, c’est l’exécution. Jobs et son équipe prirent les idées de Xerox, les améliorèrent, les mirent en œuvre et les commercialisèrent. Xerox avait l’occasion de le faire, et s’y essaya effectivement, avec un ordinateur appelé le Xerox Star. Poussif, mal ficelé, ringard et onéreux, ce fut un fiasco. L’équipe Apple simplifia la souris de façon à ce qu’elle n’ait qu’un seul bouton, lui donna le pouvoir de déplacer des documents et d’autres articles sur toute la surface de l’écran, autorisa la modification des extensions de fichier par le déplacement d’un document qui « tombait » tout seul dans un dossier, créa des menus déroulants, et permit l’illusion de documents empilés les uns sur les autres et se chevauchant.

Apple lança le Lisa en janvier 1983 et ensuite, avec plus de succès, le Macintosh, un an plus tard. Jobs savait en dévoilant le « Mac » qu’il impulserait la révolution de l’ordinateur individuel, une machine suffisamment conviviale pour qu’on l’emporte chez soi. Lors du spectaculaire lancement du produit, Jobs traversa une scène plongée dans la pénombre pour extraire le nouvel ordinateur d’un sac en toile. Aux accents tonitruants de la musique de Vangelis – le thème original des Chariots de feu –, le mot MACINTOSH défila horizontalement sur l’écran, puis, en dessous, les mots incroyablement génial ! s’affichèrent lettre par lettre dans une écriture élégante, comme tracés à la main. Il y eut un moment de silence stupéfait dans l’auditorium et quelques hoquets de surprise. La plupart des invités n’avaient jamais vu ni même imaginé quelque chose d’aussi spectaculaire. Puis l’écran fit défiler des échantillons de polices de caractères, des documents, des graphiques, des dessins, un jeu d’échecs, un tableur, et un portrait de Steve Jobs avec au-dessus de la tête un phylactère contenant le Macintosh. L’ovation dura cinq minutes110.

Le lancement du Macintosh fut accompagné par un spot publicitaire mémorable, « 1984 », où la jeune héroïne distançait la police d’un gouvernement autoritaire pour lancer un marteau dans l’écran et détruire Big Brother. En clair, Jobs le rebelle s’attaquant à IBM. Et Apple avait maintenant un avantage : ses ingénieurs avaient perfectionné et mis en application une interface graphique, le nouveau grand bond en avant dans l’interaction humain-machine, tandis qu’IBM et le fournisseur de son système d’exploitation Microsoft en étaient encore à des commandes saisies au clavier et suggérées par des invites à la « c :\> ».

Windows

Au début des années 1980, avant l’introduction du Macintosh, Microsoft entretenait de bonnes relations avec Apple. En fait, le jour où IBM lança son PC en août 1981, Gates rendait visite à Jobs chez Apple, ce qui arrivait régulièrement puisque Microsoft réalisait le gros de ses revenus en écrivant des logiciels pour Apple. Gates était encore le demandeur dans cette relation. En 1981, Apple avait engrangé trois cent trente-quatre millions de dollars, et Microsoft quinze millions. Jobs voulait que Microsoft écrive de nouvelles versions de ses logiciels pour le Macintosh, qui était encore un projet secret. Lors de leur rencontre d’août 1981, il révéla ses plans à Gates.

Gates trouva que l’idée du Macintosh – un ordinateur bon marché pour les masses populaires, doté une interface graphique simple – était, comme il le formula, « super chouette ». Gates était disposé à faire écrire à Microsoft des logiciels d’application pour le Macintosh – il était même impatient de commencer. Aussi invita-t-il Jobs à Seattle. Dans la présentation qu’il fit devant les ingénieurs de Microsoft, Jobs fut charismatique, au mieux de sa forme. Non sans une certaine licence poétique, il fila sa métaphore visionnaire d’une usine en Californie qui prendrait du sable, matière première du silicium, et produirait à la chaîne un « appareil informationnel » tellement simple qu’il n’aurait pas besoin de manuel. Les gens de Microsoft donnèrent au projet le nom de code Sand (« sable »). Ils en firent même l’acronyme de Steve’s Amazing New Device (« le stupéfiant nouveau système de Steve »)111.

Jobs avait un gros souci avec Microsoft : il ne voulait pas que la firme de Seattle copie l’interface graphique. Sentant instinctivement ce qui séduirait le consommateur moyen, il savait que le bureau virtuel avec sa navigation par pointage et cliquage serait, s’il était correctement réalisé, la percée qui rendrait les ordinateurs vraiment individuels. Lors d’un colloque du design à Aspen en 1981, il s’épancha en termes éloquents sur la convivialité future des écrans d’ordinateur utilisant « des métaphores que les gens comprennent déjà, comme celles de documents sur un bureau ». Sa crainte de voir Gates lui voler cette idée était quelque peu ironique, puisqu’il avait lui-même déjà dérobé le concept à Xerox. Mais, du point de vue de Jobs, il avait conclu un accord commercial lui donnant le droit de s’approprier l’idée de Xerox. En plus, il l’avait améliorée.

Aussi Jobs inséra-t-il dans son contrat avec Microsoft une clause dont il croyait qu’elle donnerait à Apple au moins un an d’avance en ce qui concerne l’interface graphique. Elle stipulait que pendant une certaine période Microsoft ne produirait pour aucune autre société qu’Apple de logiciel qui « utilise une souris ou une boule de commande » ou comporte une interface graphique de type pointage-cliquage. Mais Jobs fut trahi par son champ de distorsion de la réalité. Il tenait tellement à mettre le Macintosh sur le marché fin 1982 au plus tard qu’il se persuada qu’il y arriverait. Aussi convint-il que l’interdiction durerait jusqu’à fin 1983. Or il se trouva que les premiers Macintosh ne furent pas livrés avant janvier 1984.

En septembre 1981, Microsoft commença secrètement à élaborer un nouveau système d’exploitation pour remplacer MS-DOS, fondé sur le bureau virtuel avec ses fenêtres, ses icônes, sa souris et son curseur. Il débaucha un ingénieur logiciel du Xerox PARC, Charles Simonyi, qui avait travaillé aux côtés d’Alan Kay dans la création de programmes graphiques pour le Xerox Alto. En février 1982, le Seattle Times publia une photo de Gates et d’Allen, qui, comme aurait pu le remarquer un lecteur attentif, révélait un tableau blanc à l’arrière-plan avec quelques croquis et les mots Window Manager (« gestionnaire de fenêtres ») en haut. En été de la même année, juste au moment où Jobs commençait à se rendre compte que la date de sortie du Macintosh allait être décalée jusqu’à fin 1983 au plus tôt, il devint paranoïaque. Ses craintes se renforcèrent lorsque son ami Andy Herzfeld, un ingénieur de l’équipe du Macintosh, lui signala que son contact chez Microsoft avait commencé à lui poser des questions précises sur la manière dont l’image matricielle était réalisée. « J’ai dit à Steve que je soupçonnais Microsoft de vouloir cloner le Mac », se rappelle Herzfeld112.

Les craintes de Jobs se concrétisèrent en novembre 1983, deux mois avant le lancement du Macintosh, quand Gates tint une conférence de presse au Palace Hotel de Manhattan. Il annonça que Microsoft était en train de développer un nouveau système d’exploitation, qui serait disponible pour l’IBM PC et ses clones. Il comporterait une interface graphique et s’appellerait Windows.

Gates était dans son droit. L’accord contraignant avec Apple expirait fin 1983, et Microsoft n’avait pas l’intention de livrer Windows avant une date assez éloignée. (Finalement, Microsoft mettrait tellement de temps à achever une version 1.0 – bâclée, en plus –, que Windows ne serait pas livrable avant novembre 1985.) Néanmoins Jobs était blême de colère, ce qui n’était pas beau à voir. « Convoque-moi Gates immédiatement », ordonna-t-il à l’un de ses directeurs. Gates obtempéra, mais il ne se laissa pas intimider. « Il m’a fait venir pour passer sa colère sur moi, raconte Gates. Je suis descendu à Cupertino comme pour une représentation officielle. Je lui ai dit : “On est en train de faire Windows. On mise sur l’interface graphique.” » Dans une salle de conférence remplie d’employés Apple terrorisés, Jobs vociféra « Mais tu nous arnaques ! Je t’ai fait confiance, et maintenant tu nous voles113 ! » Gates avait l’habitude de se calmer progressivement chaque fois que Jobs se mettait dans une colère noire. À la fin de la tirade de Jobs, Gates le regarda, puis, avec sa voix haut perchée, lui répondit par ce qui deviendrait une réplique célèbre : « Eh bien, Steve, je crois qu’il n’y a pas qu’une seule manière de voir les choses. Je crois que c’est plutôt comme si nous avions un riche voisin nommé Xerox, et quand je l’ai cambriolé pour lui voler sa télé, je me suis aperçu que tu l’avais déjà volée114. »

Jobs lui en voulut jusqu’à la fin de sa vie. « Ils nous ont arnaqués jusqu’à l’os, parce que Gates ne connaît pas la honte », dirait-il près de trente ans plus tard, peu avant sa mort. Quand on lui rapporta ces propos, Gates répliqua : « S’il croit ça, c’est qu’il est vraiment entré dans un de ses propres champs de distorsion115. »

Finalement, les tribunaux décrétèrent que Gates avait agi correctement du point de vue juridique. La décision d’une cour d’appel fédérale notait que « les interfaces utilisateur graphiques ont été développées comme un moyen convivial permettant au commun des mortels de dialoguer avec l’ordinateur Apple […] fondé sur la métaphore d’un bureau avec des fenêtres, des icônes et des menus déroulants qui peuvent se manipuler à l’écran grâce à un périphérique manuel appelé souris ». Mais la cour décida qu’« Apple ne peut bénéficier d’une protection dans le cadre d’un brevet pour l’idée d’une interface utilisateur graphique, ou pour l’idée d’une métaphore du bureau ». Il était presque impossible de protéger une innovation portant sur l’aspect et la convivialité.

Quel qu’ait pu être le contexte juridique, Jobs avait le droit d’être en colère. Apple avait été plus novateur, plus imaginatif, plus élégant dans l’exécution et plus intelligent dans la conception. L’interface utilisateur de Microsoft était bâclée, avec un tuilage de l’écran par des fenêtres qui ne pouvaient pas se chevaucher et des graphismes qu’on aurait cru dessinés par des ivrognes dans un sous-sol sibérien.

À force de persévérance, Windows finit néanmoins par atteindre sa position dominante, non parce que sa conception était meilleure, mais parce que son modèle économique était meilleur. La part du marché détenue par Microsoft atteignait déjà quatre-vingts pour cent en 1990 et ne cessa de progresser, pour atteindre quatre-vingt-quinze pour cent dès 2000. Pour Jobs, le succès de Microsoft représentait un défaut esthétique dans le fonctionnement de l’univers. « Le problème de Microsoft est qu’ils n’ont carrément pas de goût, absolument pas de goût, dirait-il plus tard. Je ne veux pas dire dans le détail, mais en général, dans la mesure où ils n’ont pas d’idées originales et qu’ils ne mettent pas beaucoup de culture dans leur produit116. »

La principale raison du succès de Microsoft était qu’il était disposé à laisser tous les fabricants de matériel à intégrer sous licence son système d’exploitation à leurs ordinateurs. Apple, au contraire, opta pour une solution fermée. Son matériel ne fonctionnait qu’avec son logiciel, et vice versa. Jobs était un artiste, un perfectionniste, et donc un maniaque du contrôle qui voulait diriger de bout en bout l’expérience de l’utilisateur. La démarche d’Apple conduisait à des produits plus esthétiques, une marge bénéficiaire plus élevée et une expérience utilisateur plus sublime. La démarche de Microsoft offrait un choix plus étendu de matériel. Il se trouve qu’elle était aussi un meilleur choix pour gagner des parts de marché.

Richard Stallman, Linus Torvalds et les mouvements du logiciel libre et de l’open source

Fin 1983, juste au moment où Jobs se préparait à dévoiler le Macintosh et où Gates annonçait Windows, une autre conception de la création de logiciels se manifesta. Elle était impulsée par l’un des purs et durs du Laboratoire d’intelligence artificielle du MIT et du Tech Model Railroad Club, Richard Stallman, un hacker au look de prophète de l’Ancien Testament, persuadé de détenir la vérité. Avec une ferveur morale encore plus forte que celle des membres du Homebrew Club qui copiaient les bandes du Microsoft BASIC, Stallman croyait à la création collaborative des logiciels et à leur libre partage117.

Au premier abord, ce ne semblait pas être une démarche susceptible d’encourager les gens à produire des logiciels de qualité. La joie du libre partage n’était pas ce qui motivait Gates, Jobs et Bricklin. Mais comme la culture hacker était imprégnée d’une éthique collaborative et communautaire, les mouvements du logiciel libre et de l’open source finirent par devenir des forces puissantes.

Né en 1953, Richard Stallman se découvrit un vif intérêt pour les mathématiques pendant son enfance à Manhattan, et il apprit le calcul intégral tout seul. « Les mathématiques ont quelque chose de commun avec la musique, dirait-il plus tard. Elles se fondent sur des relations vraies, des étapes logiques vraies, des déductions vraies, et c’est là que réside leur beauté. » Contrairement à ses camarades de classe, il était profondément opposé à l’esprit de compétition. Lorsqu’au lycée le professeur divisa la classe en deux équipes pour un jeu-concours, Stallman refusa de répondre aux questions. « J’ai résisté à l’idée de compétition, expliqua-t-il. Je voyais que j’étais manipulé et que mes camarades étaient la proie de cette manipulation. Ils voulaient tous battre les autres, qui étaient tout autant leurs amis que ceux de leur propre équipe. Ils ont commencé à exiger que je réponde aux questions pour nous faire gagner. Mais j’ai résisté à la pression parce que je n’avais aucune préférence pour l’une ou l’autre équipe118. »

Stallman étudia à Harvard, où il devint une légende même parmi les génies des maths ; chaque été et après avoir obtenu sa licence, il travaillait au Laboratoire d’intelligence artificielle du MIT, à deux stations de métro de Cambridge. C’est là qu’il perfectionna le réseau du train électrique du Tech Model Railroad Club, qu’il écrivit un programme d’émulation du PDP-11 qui tournait sur le PDP-10 et qu’il tomba amoureux de la culture collaborative : « J’ai intégré la communauté fondée sur le partage des logiciels, qui existait depuis de nombreuses années. Chaque fois que des gens d’une autre université ou d’une autre société voulaient acclimater un programme chez eux, nous les laissions faire. On pouvait toujours demander à voir le code source119. »

En bon hacker, Stallman défiait les restrictions et les portes verrouillées. Avec ses amis étudiants, il conçut de multiples méthodes pour entrer par effraction dans des bureaux contenant des terminaux interdits d’accès ; sa spécialité personnelle était de ramper dans les faux plafonds, d’écarter une dalle et de laisser descendre un long morceau de bande magnétique muni à son extrémité de ruban adhésif pour manipuler les poignées de porte. Lorsque le MIT constitua une base de données des utilisateurs et un système de mots de passe forts, Stallman résista et encouragea ses collègues à faire de même : « J’ai trouvé ça dégueulasse, alors je n’ai pas rempli le formulaire et j’ai créé un mot de passe sans contenu. » À un moment donné, un professeur l’avertit que l’université risquait d’effacer son répertoire de fichiers. Ce serait regrettable pour tout le monde, répondit Stallman, puisque certaines des ressources du système se trouvaient dans son répertoire120.

Malheureusement pour lui, la fraternité des hackers du MIT commença à s’effriter au début des années 1980. Le laboratoire acheta un nouvel ordinateur en temps partagé doté de logiciels propriétaires. « Il fallait signer un engagement de non-divulgation rien que pour pouvoir disposer d’une copie exécutable, déplorait Stallman. Ce qui signifiait que la première étape dans l’utilisation d’un ordinateur était de promettre de ne pas aider son prochain. Une communauté coopérative était interdite121. »

Au lieu de se rebeller, beaucoup de ses collègues rejoignirent des éditeurs de logiciels à but lucratif, notamment un sous-produit du laboratoire du MIT appelé Symbolics, où ils gagnèrent beaucoup d’argent en ne partageant pas gratuitement. Stallman, qui dormait parfois dans son bureau et donnait l’impression de s’habiller dans une friperie, ne partageait pas leurs motivations axées sur le profit et les considérait comme des traîtres. Le comble, ce fut quand Xerox fit don d’une imprimante laser neuve et que Stallman voulut installer un logiciel qui détecterait le blocage de la machine et avertirait les autres usagers du réseau. Il demanda à un collègue de lui fournir le code source de l’imprimante, mais l’autre refusa en disant qu’il avait signé un engagement de non-divulgation. Stallman fut scandalisé.

Tous ces événements confortèrent Stallman dans son personnage de Jérémie s’élevant contre l’idolâtrie et prêchant à partir de son livre des lamentations : « Certaines personnes me comparent à un prophète de l’Ancien Testament, et la raison en est que les prophètes de l’Ancien Testament disaient que certaines pratiques sociales étaient néfastes. Ils n’acceptaient pas de compromis sur des questions de morale122. » Stallman non plus. Les logiciels propriétaires étaient « néfastes », disait-il, parce qu’« ils exigeaient des gens qu’ils acceptent de ne pas partager et c’est cela qui rendait la société répugnante ». Le moyen de résister aux forces du mal et de les vaincre était donc pour lui la création de logiciels libres.

En 1982, dégoûté par l’égoïsme qui semblait s’être emparé de la société à l’ère Reagan tout comme des entrepreneurs du logiciel, Stallman se lança dans une mission : créer un système d’exploitation qui soit libre et totalement autonome (« non propriétaire »). Afin d’empêcher le MIT d’en revendiquer les droits, il démissionna de son poste au Laboratoire d’intelligence artificielle, en conservant toutefois, grâce à l’indulgence de son supérieur, sa clé et le droit d’utiliser les ressources du laboratoire. Le système d’exploitation que Stallman décida de développer serait comparable et compatible avec UNIX, système mis au point aux laboratoires Bell en 1971 et la référence pour la plupart des universités et des hackers. Avec un humour subtil de programmeur, Stallman créa un acronyme récursif pour son système d’exploitation tout neuf, GNU, qui signifiait GNU’s Not UNIX – « GNU n’est pas UNIX ».

Dans le numéro de mars 1985 du Dr. Dobb’s Journal, publication émanant du Homebrew Computer Club et de la People’s Computer Company, Stallman publia un manifeste : « Je considère que la règle d’or exige que si un programme me plaît je dois le partager avec d’autres personnes à qui il plaît. Les vendeurs de logiciels veulent diviser les utilisateurs et les vaincre en obligeant chaque utilisateur à s’engager à ne pas partager avec les autres. Je refuse de rompre ainsi ma solidarité avec les autres utilisateurs […] Une fois que GNU sera rédigé, tout le monde pourra obtenir de bons systèmes d’exploitation libres comme l’air123. »

L’appellation Free Software Movement prêtait à confusion. L’objectif du mouvement n’était pas d’exiger que tous les logiciels soient libres de droits – donc gratuits –, mais qu’ils soient exemptés de toute restriction. Stallman était sans cesse obligé d’expliquer que « lorsque nous qualifions un logiciel de “libre”, nous voulons dire qu’il respecte les libertés essentielles de l’utilisateur : la liberté de l’exécuter, de l’étudier et de le modifier et d’en distribuer des copies, avec ou sans changements. C’est une question de liberté et non de prix, alors pensez à la “liberté d’expression”, pas à la “bière gratuite”. »

Pour Stallman, le mouvement du logiciel libre n’était pas simplement un moyen de développer des logiciels produits par les pairs : c’était un impératif moral visant à produire une société généreuse. Les principes mis en avant par le mouvement étaient « essentiels, non seulement pour l’utilisateur individuel, mais pour la société dans son ensemble, parce qu’ils encouragent la solidarité sociale, c’est-à-dire le partage et la coopération124 ».

Pour sanctifier et certifier ce credo, Stallman introduisit une licence publique générale GNU et aussi le concept, suggéré par un ami, du copyleft, inversion facétieuse « droite-gauche » de copyright. L’essence de la licence publique générale GNU était de donner « à tout un chacun la permission d’exécuter le programme, de copier le programme, de modifier le programme et d’en diffuser des versions modifiées – mais pas la permission de lui ajouter soi-même des restrictions125 ».

Stallman rédigea personnellement les premiers éléments du système d’exploitation GNU – un éditeur de texte, un compilateur et bien d’autres outils. Mais il devenait de plus en plus évident qu’il manquait un élément essentiel. « Et le noyau ? » demanda le magazine Byte dans une interview de Stallman en 1986. Module central de tout système d’exploitation, le noyau traite les requêtes émanant des programmes et les transforme en instructions pour l’unité centrale de l’ordinateur. « Je suis en train de terminer le compilateur avant de me mettre au travail sur le noyau, répondit Stallman. Je vais aussi être obligé de récrire le système de fichiers126. »

Pour diverses raisons, il eut du mal à terminer l’élaboration d’un noyau pour GNU. Puis, en 1991, il y en eut un de disponible, qui n’émanait pas de Stallman ni de sa Free Software Foundation, mais d’une source tout à fait inattendue : un juvénile et souriant Finnois suédophone, étudiant à l’université d’Helsinki, nommé Linus Torvalds.

Le père de Linus Torvalds était membre du parti communiste et journaliste de télévision, et sa mère, ancienne étudiante radicalisée, était journaliste de la presse écrite, mais pendant son enfance à Helsinki le jeune Linus s’intéressa plus à la technologie qu’à la politique127. Il se décrivait lui-même comme « bon en maths, bon en physique, et sans aucune grâce sociale que ce soit, et c’était avant que le fait d’être un nerd soit bien vu128 ». Surtout en Finlande.

Quand il eut dix ans, son grand-père, professeur de statistiques à l’université, lui donna un vieux Commodore Vic 20, l’un des premiers ordinateurs individuels. Torvalds commença à écrire ses propres programmes en BASIC, dont un qui affichait à répétition « Sara est la meilleure » pour amuser sa petite sœur. « L’une de mes plus grandes joies, disait-il, c’était d’apprendre que l’informatique est comme les mathématiques : on peut créer son propre monde avec ses propres règles. »

Restant sourd aux suggestions de son père qui le pressait d’apprendre à jouer au basket, Torvalds se concentra à la place sur l’écriture des programmes en langage machine, les instructions numériques directement exécutées par l’unité centrale d’un ordinateur, ce qui lui donna la joie « d’avoir une relation intime avec une machine ». Plus tard, il se félicita d’avoir appris l’assembleur et le langage machine sur un matériel très basique : « Les ordinateurs étaient en réalité plus intéressants pour les enfants quand ils étaient moins sophistiqués, quand des nullards comme moi pouvaient bricoler sous le capot129. » À l’instar des moteurs de voiture, les ordinateurs finirent par être difficiles à démonter et remonter.

Après s’être inscrit à l’université d’Helsinki en 1988 et avoir accompli son année de service militaire, Torvalds s’acheta un clone IBM doté d’un processeur Intel 386. Peu impressionné par le MS-DOS produit par Gates et Microsoft, il décida d’installer UNIX, qu’il avait appris à aimer sur les gros systèmes informatiques de l’université. Mais UNIX coûtait cinq mille dollars par exemplaire et n’était pas configuré pour tourner sur un ordinateur domestique. Torvalds entreprit d’y remédier.

Il lut un ouvrage sur les systèmes d’exploitation écrit par un professeur d’informatique d’Amsterdam, Andrew Tanenbaum, qui avait développé MINIX, un petit clone d’UNIX, à des fins pédagogiques. Résolu à remplacer le MS-DOS par MINIX sur son PC, Torvalds acheta la licence d’exploitation pour cent soixante-neuf dollars (« j’ai trouvé ça scandaleux »), installa le contenu des seize disquettes puis se mit à compléter et à modifier MINIX à son goût.

Sa première addition était un programme d’émulation de terminal de façon à se connecter à l’ordinateur central de l’université. Il rédigea le programme à partir de zéro en assembleur, « au niveau matériel minimal » pour ne pas à avoir à dépendre de MINIX. À la fin du printemps 1991, il commença à programmer juste au moment où le soleil sortait de son hibernation. Tout le monde était dehors, sauf lui. « Je passais le plus clair de mon temps en peignoir, penché sur mon très peu séduisant nouvel ordinateur, avec d’épais rideaux noirs aux fenêtres pour me protéger du soleil. »

Une fois qu’il eut réussi à faire fonctionner un émulateur de terminal rudimentaire, il voulut pouvoir télécharger et charger des fichiers, aussi élabora-t-il un pilote de disque et un pilote de système de fichier. « Quand j’ai fait ça, il était déjà clair que le projet se dirigeait vers la construction d’un système d’exploitation. » Autrement dit, il se lançait dans l’élaboration d’un ensemble de logiciels qui pourrait servir de noyau à un système d’exploitation inspiré d’UNIX. « Une minute, toujours vêtu de mon vieux peignoir, je suis en train de pianoter sur un émulateur de terminal doté de fonctions supplémentaires. La minute d’après, je m’aperçois qu’il accumule tellement de fonctions qu’il est devenu un nouveau système d’exploitation en cours de construction. » Torvalds identifia les centaines d’« appels système » dont était capable UNIX pour faire exécuter à l’ordinateur des opérations de base comme Ouvrir et Fermer, Lire et Écrire, puis rédigea des programmes pour les mettre en œuvre à sa manière. Il habitait encore dans l’appartement de sa mère et se disputait souvent avec sa sœur, qui avait une vie normale, parce que son modem monopolisait leur ligne téléphonique. « Personne ne pouvait nous appeler », déplorait-elle130.

Au début, Torvalds voulait appeler son nouveau logiciel « Freax », concaténation de free et de freaks évoquant la liberté du logiciel et les chevelus excentriques, le « x » final étant censé rappeler celui d’UNIX. Mais ce nom déplut à l’administrateur du site FTP qu’il utilisait, et Torvalds opta pour « Linux », qu’il prononçait sans diphtonguer le i, comme son prénom scandinave131. « Je n’ai jamais voulu utiliser ce nom, parce que je trouvais que, hein, c’était un peu égocentrique », disait-il. Il admettrait plus tard qu’une partie de son ego appréciait une reconnaissance tardive après avoir vécu tant d’années dans le corps d’un nerd renfermé, et qu’il ne regrettait pas d’avoir choisi ce nom132.

Au début de l’automne 1991, quand le soleil d’Helsinki commença à disparaître, Torvalds réapparut avec la coquille génératrice de son système, qui contenait dix mille lignes de code*5. Au lieu d’essayer de commercialiser ce qu’il avait produit, il décida carrément de le mettre à disposition gratuitement. Il avait récemment assisté avec un ami à une conférence de Stallman, qui était devenu un prédicateur itinérant et parcourait le globe pour répandre la doctrine du logiciel libre. En réalité, Torvalds ne se convertit ni n’embrassa le dogme : « Ça n’a probablement pas eu un grand impact sur ma vie à ce stade. Je m’intéressais au côté technologique de la chose, pas au côté politique – il y avait déjà assez de politique comme ça à la maison133. » Il n’empêche qu’il voyait très bien les avantages d’un logiciel ouvert. Presque par instinct plutôt que par choix philosophique, il avait l’impression que Linux devrait être librement partagé dans l’espoir que quiconque l’utiliserait pourrait contribuer à l’améliorer.

Le 5 octobre 1991, il afficha un message impertinent sur le forum MINIX : « Avez-vous la nostalgie des beaux jours de minix-1.1, quand les hommes étaient des hommes et élaboraient eux-mêmes les pilotes de leurs périphériques ? Je travaille sur une version libre d’un sosie de minix pour ordinateurs AT-386. Elle a enfin atteint le stade où elle est même utilisable (ou peut-être pas, cela dépend de vos besoins), et je suis disposé à en publier les sources pour une diffusion plus vaste134. »

« La décision d’afficher ça ne m’a pas coûté grand-chose, raconte Torvalds. C’est dire à quel point j’étais habitué à échanger des programmes. » Dans le monde informatique, il y avait (et il y a encore) une forte culture du shareware – le logiciel partagé –, système dans lequel les gens envoient volontairement quelques dollars à quelqu’un dont ils ont téléchargé le programme : « Je recevais des courriels de gens qui me demandaient si je voulais qu’ils m’envoient, disons, trente dollars. » Il avait économisé cinq mille dollars sur ses bourses d’étude et payait encore cinquante dollars par mois pour rembourser le crédit de son ordinateur. Mais au lieu de solliciter des dons, il demanda des cartes postales. Elles commencèrent à arriver à flots de la part de tous les gens qui utilisaient Linux dans le monde entier. « Sara était chargée de relever le courrier, et elle a été soudain impressionnée de voir que son grand frère combatif avait on ne sait comment des nouvelles de ses nouveaux amis au bout du monde. C’était pour elle le premier indice prouvant que je faisais quelque chose de potentiellement utile pendant les nombreuses heures où j’occupais la ligne. »

La décision de Torvalds de ne pas réclamer d’argent était motivée par diverses raisons, comme il l’expliquerait plus tard, y compris le désir de respecter la tradition familiale :

« J’avais l’impression de marcher sur les traces des scientifiques et des universitaires qui, au cours des siècles, avaient édifié leur œuvre sur les bases posées par les autres […] Je voulais aussi avoir des réactions (O.K., et des éloges). Il n’était pas logique de faire payer des gens qui allaient potentiellement contribuer à améliorer mon travail. Je suppose que j’aurais eu une démarche différente si je n’avais pas grandi en Finlande, où quiconque manifeste le moindre signe de cupidité est regardé d’un œil soupçonneux, sinon envieux. Et, oui, j’aurais sans aucun doute abordé toute la question du non-paiement très différemment si je n’avais pas été élevé sous l’influence d’un grand-père universitaire pur et dur et d’un père communiste pur et dur lui aussi. »

« Il n’y a jamais rien de bon dans la cupidité », déclara un jour Torvalds. Sa démarche contribua à le transformer en un héros populaire qu’on vénérait lors de congrès et sur les couvertures de magazines comme l’anti-Bill Gates. Ce charmeur se connaissait assez bien pour savoir qu’il aimait jouir de ce prestige et que cela le rendait un peu plus égocentrique que ne le pensaient ses admirateurs : « Je n’ai jamais été le techno-prodige modeste et désintéressé que la presse hallucinée voudrait que je sois135. »

Si Torvalds décida d’utiliser la licence publique générale GNU, ce n’est pas parce qu’il acceptait totalement l’idéologie du libre partage de Stellman (ou, en l’occurrence, celle de ses propres parents), mais parce qu’il estimait que laisser les bidouilleurs du monde entier manipuler le code source conduirait à un effort collaboratif ouvert qui ferait de GNU un logiciel véritablement impressionnant : « Quand j’ai mis Linux dans le domaine public, mes motivations étaient plutôt égoïstes. Je ne voulais pas me casser la tête à essayer de m’attaquer à des parties du système d’exploitation que je jugeais merdiques. J’avais besoin d’aide136. »

Son instinct avait vu juste. Sa publication du noyau Linux déchaîna un tsunami de collaborations peer-to-peer bénévoles, et ce processus devint le modèle de la production partagée qui impulserait l’innovation à l’ère numérique137. En automne 1982, un an après son lancement, le groupe de discussion dédié à Linux sur Internet comptait déjà des dizaines de milliers d’utilisateurs. Des collaborateurs désintéressés ajoutèrent des améliorations telles qu’une interface graphique à la Windows et des outils pour faciliter le réseautage des ordinateurs. Chaque fois qu’il y avait un bogue, quelqu’un, quelque part, intervenait pour le supprimer. Dans son ouvrage La Cathédrale et le bazar, Eric Raymond, l’un des théoriciens fondateurs du mouvement du logiciel ouvert, exposa ce qu’il appela la « loi de Linus » : « Étant donné suffisamment d’observateurs, tous les bogues sautent aux yeux138. »

Le partage entre pairs et la collaboration fondée sur un terrain commun n’étaient pas des nouveautés. Un domaine entier de la biologie évolutive s’est constitué autour de la question de savoir pourquoi les humains et les membres de certaines autres espèces coopèrent selon des modes apparemment altruistes. La tradition des associations bénévoles, qui se rencontre dans toutes les sociétés, était particulièrement forte dans l’Amérique des débuts, ainsi qu’en témoignaient les entreprises coopératives allant des ouvroirs de couture à la construction collective des granges. « Dans aucun autre pays du monde le principe d’association n’a été utilisé avec plus de succès, ou plus généreusement appliqué à une multitude d’objets différents qu’en Amérique », écrivait Tocqueville139. Dans son Autobiographie, Benjamin Franklin exposait tout un credo civique, avec la devise « Répandre des bienfaits pour la communauté est d’essence divine », afin d’expliquer sa formation d’associations bénévoles pour créer un hôpital, une milice, un corps de balayeurs, une brigade de pompiers, une bibliothèque de prêt, une patrouille de nuit et bien d’autres entreprises communautaires.

Le corps de bidouilleurs qui se créa autour de GNU et de Linux montra qu’au-delà des récompenses financières, les incitations émotionnelles peuvent motiver une collaboration bénévole. « L’argent n’est pas le plus grand des motivateurs, disait Torvalds. Les gens produisent leur meilleur travail quand ils sont mus par la passion. Quand ils y prennent plaisir. C’est aussi vrai pour les dramaturges, les sculpteurs et les entrepreneurs que ça l’est pour des ingénieurs logiciel. Il y a aussi, consciemment ou pas, un certain intérêt personnel. « Les bidouilleurs sont aussi motivés, en grande partie, par l’estime dont ils peuvent jouir aux yeux de leurs pairs en apportant de solides contributions […] Tout un chacun veut impressionner ses pairs, améliorer sa réputation, relever son statut social. Le développement de l’open source en donne aux programmeurs la possibilité. »

Dans sa « Lettre ouverte aux amateurs », où il déplorait le partage non autorisé du Microsoft BASIC, Gates demandait sur le ton de la réprimande : « Qui peut avoir les moyens d’accomplir un travail professionnel sans être rémunéré ? » Torvalds trouva ce point de vue bizarre. Gates et lui venaient de deux cultures très différentes – le milieu universitaire radicalisé à tendance communiste d’Helsinki opposé à l’élite entrepreneuriale de Seattle. Gates avait peut-être fini par avoir la plus grande demeure, mais Torvalds récolta l’adulation des anticonformistes. « Les journalistes, disait-il avec une lucidité ironique, semblaient adorer le fait que Gates vivait dans une résidence high-tech au bord d’un lac tandis que je trébuchais sur les jouets de ma fille dans les trois pièces d’une maison en rez-de-chaussée à la plomberie défectueuse. Et ce, dans l’ennuyeuse localité de Santa Clara. Et que je roulais dans une vulgaire Pontiac. Et que je répondais moi-même au téléphone. On ne pouvait que m’adorer, non ? »

Torvalds réussit à maîtriser l’art, typique de l’ère numérique, d’être le leader plébiscité d’une collaboration massive, décentralisée et non hiérarchique, ce que Jimmy Wales faisait avec Wikipedia à peu près à la même époque. La première règle dans une telle situation est de prendre des décisions comme un ingénieur, en se fondant sur le mérite technique plutôt que sur des considérations personnelles. « C’était pour moi un moyen d’obtenir la confiance des gens, explique Torvalds. Quand les gens vous font confiance, ils suivent vos conseils. » Il se rendit compte aussi que les dirigeants d’un collectif bénévole doivent encourager les autres à suivre leur passion et non leur donner des ordres : « Le meilleur et le plus efficace moyen de diriger est de laisser les gens faire des trucs parce qu’ils veulent les faire, et non parce que vous voulez qu’ils les fassent. » Pareil leader sait comment émanciper des groupes jusqu’à l’auto-organisation. Faite correctement, une structure de gouvernance par consensus émerge naturellement, comme cela s’est produit à la fois pour Linux et Wikipedia. « Ce qui étonne des tas de gens, c’est que le modèle de l’open source marche effectivement, dit Torvalds. Les gens savent qui a été actif et à qui ils peuvent faire confiance, et ça marche tout seul. Pas de vote. Pas d’ordres. Pas de recomptages140. »

La combinaison de GNU avec Linux représentait, au moins au niveau du concept, le triomphe de la croisade de Richard Stallman. Mais les prophètes moraux se complaisent rarement à célébrer leurs victoires. Stallman était un puriste. Pas Torvalds. Le noyau Linux qu’il finit par diffuser contenait quelques bribes de logiciel propriétaire. Il pouvait y être remédié ; et, de fait, la Free Software Foundation de Stallman en créa une version qui était complètement libre et autonome. Mais il y avait pour Stallman un problème plus profond et plus émotionnel. Il se plaignait que désigner par « Linux » le système d’exploitation, ce que presque tout le monde faisait, était un abus de langage. Linux était le nom du noyau. Le système tout entier devrait s’appeler GNU/Linux, soulignait-il, parfois agressivement. Un spectateur qui avait assisté à une exposition de logiciels se rappela comment Stallman avait réagi quand un garçon de quatorze ans un peu nerveux lui avait posé une question sur Linux. Et il le sermonna plus tard vigoureusement : « J’ai tout vu : tu as démoli le pauvre môme, il a tiré une sale tronche et sa dévotion à toi et à ta cause s’est ratatinée d’un coup141. »

Stallman tenait aussi à ce que l’objectif soit de créer ce qu’il appelait des « logiciels libres » (free software), expression qui reflétait une obligation morale de partager. Il critiquait l’expression que Torvalds et Eric Raymond commencèrent à employer, « logiciels à code source ouvert » (open-source software), qui soulignait l’objectif pragmatique de faire collaborer les utilisateurs pour créer des logiciels avec plus d’efficacité. Dans la pratique, la plupart des logiciels dit « libres » sont aussi « open source », et vice versa ; on les assimile habituellement sous la rubrique des « logiciels libres et en open source ». Or, pour Stallman, ce n’était pas seulement la manière dont vous produisiez votre logiciel qui comptait, mais aussi vos motivations. Sinon le mouvement risquait de tomber dans le compromis et de se corrompre.

Ces différends dépassèrent le stade littéral et devinrent parfois idéologiques. Moralement sûr de lui et comme auréolé d’intransigeance, Stallman déplorait que « quiconque encourage l’idéalisme aujourd’hui affronte un gros obstacle : l’idéologie dominante encourage les gens à réfuter l’idéalisme comme étant “impraticable”142. »Torvalds, au contraire, n’avait aucune honte à avoir le sens pratique de l’ingénieur : « Je conduisais les pragmatistes. J’ai toujours pensé que les idéalistes sont intéressants, mais quelque peu ennuyeux et inquiétants143. »

Torvalds avouait « ne pas être un grand admirateur » de Stallman. « Je n’aime pas les gens arrêtés sur une idée fixe, expliquait-il. Et je ne pense pas non plus que les gens qui voient le monde en noir et blanc soient très sympathiques ou, en dernière analyse, très utiles. Le fait est que tout problème n’a pas que deux aspects antagonistes, il y a toujours une gamme de réponses, et “ça dépend” est presque toujours la réponse correcte à toute question importante144. » Il croyait aussi qu’il devrait être permis de gagner de l’argent avec des logiciels en open source. « Le principe de l’open source est de laisser tout le monde participer. Pourquoi faudrait-il en exclure le commerce, qui alimente si puissamment les avancées technologiques de la société145 ? Les logiciels veulent peut-être être libres (et gratuits), mais les gens qui les écrivent veulent peut-être nourrir leurs enfants et récompenser leurs investisseurs.

Ces querelles ne devraient pas faire oublier les prouesses stupéfiantes qui furent l’œuvre de Stallman, Torvalds et de leurs milliers de collaborateurs. La combinaison de GNU et de Linux a créé un système d’exploitation qui s’est avéré « portable » sur plus de plates-formes, depuis les dix plus gros superordinateurs du monde jusqu’aux téléphones mobiles, que tout autre système d’exploitation. « Linux est subversif, écrivait Eric Raymond. Qui aurait cru qu’un système d’exploitation de classe mondiale puisse se concrétiser comme par magie à partir du bidouillage à temps perdu de plusieurs milliers de développeurs dispersés sur toute la planète, uniquement connectés par les fils ténus d’Internet146 ? » En plus d’être devenu un système d’exploitation remarquable, il a inspiré la production collaborative fondée sur un terrain commun dans d’autres domaines, depuis le navigateur Firefox de Mozilla jusqu’au contenu de Wikipedia.

Dans les années 1990 existaient déjà de nombreux modèles de développement de logiciels. Il y avait la démarche Apple, qui liait étroitement le matériel au logiciel du système d’exploitation, du Macintosh à l’iPhone en passant par tous les « iProduits » intermédiaires. Elle débouchait sur une expérience utilisateur sans failles. Il y avait la démarche Microsoft, dans laquelle le système d’exploitation était indépendant du matériel. Ce qui donnait plus de choix aux utilisateurs. En outre, il y avait les démarches du logiciel libre et de l’open source, qui permettaient au logiciel d’être complètement autonome et d’être modifiable par n’importe quel utilisateur. Chaque modèle avait ses avantages, chacun avait ses propres incitations à la créativité, chacun avait ses prophètes et ses disciples. Mais la démarche la plus fructueuse était de faire coexister les trois modèles, avec, en parallèle, diverses combinaisons de logiciels ouverts et fermés, liés et autonomes, propriétaires et libres. Windows et Mac, UNIX et Linux, iOS et Android : des démarches variées en concurrence pendant des décennies, qui se stimulent mutuellement et surtout empêchent qu’un modèle devienne dominant au point d’étouffer l’innovation.

William von Meister (1942-1995).

Steve Case (né en 1958).

*1. Après être devenus riches et célèbres, Gates et Allen financèrent un nouveau bâtiment des sciences à Lakeside, dont l’auditorium porte le nom de Kent Evans.

*2. La réticence de Steve Wozniak à se colleter avec cette tâche ingrate quand il écrivait un BASIC pour l’Apple II forcerait plus tard Apple à utiliser sous licence le BASIC d’Allen et Gates.

*3. En lisant sur Internet une version provisoire du présent ouvrage, Steve Wozniak a dit que Dan Sokol n’avait fait que huit copies, parce qu’elles étaient difficiles à faire et que cela prenait beaucoup trop de temps. Mais John Markoff, qui avait relaté l’incident dans Ce que disait le Loir, m’a communiqué (ainsi qu’à S. Wozniak et à L. Felsenstein) la transcription de son entretien avec Dan Sokol, lequel disait qu’il s’était servi d’un PDP-ll doté d’un lecteur/perforateur de bande à grande vitesse. Chaque soir, il faisait des copies, et il estimait en avoir fait en tout soixante-quinze.

*4. Les juristes avaient raison de s’inquiéter. Microsoft fut plus tard impliqué dans un interminable procès antitrust mené par le ministère de la Justice, qui l’accusa d’avoir abusé de sa position dominante sur le marché des systèmes d’exploitation pour s’octroyer un avantage dans les navigateurs et d’autres produits. L’affaire fut finalement réglée quand Microsoft eut accepté de modifier certaines de ses pratiques.

*5. En 2009, la version Debian 5.0 de GNU/Linux comportait trois cent vingt-quatre millions de lignes de code, et une étude estima que son développement par des moyens conventionnels aurait coûté huit milliards de dollars (http://gsyc.es/~frivas/paper.pdf).