12

El universo fugitivo

El universo podría ser como Los Ángeles.

Un tercio sustancia y dos tercios energía.

Robert Kirshner[424]

El universo de saldo

Las personas cuerdas se enorgullecen de su capacidad para no verse afectadas por los acontecimientos importantes y para interesarse por los que no lo son. A esto se le llama tener sentido de la perspectiva, o mantener las cosas «en su justa medida» […]

Celia Green[425]

Durante el verano de 1996 se celebró una gran conferencia sobre cosmología en Princeton, New Jersey, como parte del 250 aniversario de la fundación de la Universidad de Princeton[426]. Las condiciones meteorológicas —calor, humedad sofocante y tormentas eléctricas— eran atroces, y el mal estado del aire acondicionado de la vieja residencia de estudiantes, en la que los participantes se alojaban a su pesar, no ayudaba demasiado. Llegar al auditorio era un verdadero alivio. Una de las novedades de esta conferencia fue que no ofrecía simplemente la habitual gama de charlas, sino que parejas y tríos de conferenciantes actuaban como candidatos políticos que «vendían» un modelo de universo determinado de preferencia al que ofrecían sus rivales. Después de exponer sus argumentos, los conferenciantes iniciaban un debate crítico entre sí en el que el público podía participar.

En general, los cosmólogos de la época estaban satisfechos con la idea del universo inflacionario y no se planteaban demasiado las ideas de inflación caótica o eterna, y la palabra «multiverso» ni siquiera estaba en su diccionario, aunque el concepto era conocido de los viejos argumentos antrópicos. La conferencia estaba más centrada en las observaciones detalladas sobre el ritmo de expansión del universo, su edad y la respuesta a las preguntas de si se podían formar galaxias a tiempo y si el patrón de falta de uniformidad de la materia y la radiación del universo se ajustaba a alguna de las teorías del origen de las irregularidades a partir de la inflación en el universo primigenio.

El desafío para cada uno de los cosmólogos consistía en demostrar que su modelo del contenido de materia del universo y del tipo de expansión era el que mejor se ajustaba a todas las observaciones. El favorito resultó ser el modelo, defendido por Michael Turner, de que la expansión tenía lugar casi al ritmo crítico, como predecía la inflación, pero cuya constante cosmológica, inventada y luego rechazada por Einstein, tenía un valor positivo pequeño, y su efecto gravitatorio repulsivo era el responsable de la aceleración actual del universo. Como señaló el propio Turner, el éxito de este modelo sobre sus rivales no fue precisamente una sorpresa, ya que eran modelos prácticamente idénticos salvo por una cantidad adicional (la constante cosmológica) que podía modificarse para ajustarse un poco mejor a las observaciones.

Este modelo triunfante había sido bautizado como «Lambda-CDM»: «Lambda» describe la constante cosmológica, mientras que «CDM» es la abreviatura de «cold dark matter» (materia oscura fría en inglés). Con esto se etiquetaba la forma de materia necesaria en todas las descripciones del universo para dar cuenta del hecho de que, según las observaciones, la abundancia de materia luminosa era diez veces demasiado pequeña para explicar la intensidad de los campos gravitatorios en galaxias y cúmulos. Para explicar esta discordancia tenía que haber un montón de materia oscura. Tenía que residir en una forma especial que solo participase en interacciones gravitatorias o débiles; en caso contrario suprimiría la producción de núcleos de deuterio por debajo del valor observado cuando el universo tenía tres minutos de edad. Eso significaba que lo más probable era que la materia oscura fuese neutrinos o un nuevo tipo de partícula similar al neutrino, capaz de verse afectada por la interacción débil. Los tipos de neutrinos conocidos no reunían las condiciones necesarias. Eran demasiado ligeros y creaban patrones de acumulación incorrectos cuando se exploró su comportamiento por primera vez en 1985 mediante complejas simulaciones por ordenador del universo en expansión[427].

Para cumplir todos estos requisitos, esas partículas similares a los neutrinos tenían que ser mucho más pesadas que los protones y, por consiguiente, muy lentas; de ahí el apelativo «fría» (temperatura no es más que el nombre que utilizamos para referimos a la velocidad media de las moléculas en un gas). Su conducta pesada generaba un tipo característico de acumulación de galaxias en pequeña escala en las simulaciones por ordenador, que se ajustaba en gran medida a las observaciones. Lambda-CDM, con el parámetro lambda adicional, quedó en cabeza en todas las tablas de clasificación astronómicas. Pero a nadie le emocionó demasiado el éxito de Lambda-CDM, ni siquiera a su defensor: era demasiado artificioso y, a decir verdad, realmente feo.

Este universo a medida se parecía mucho al universo de Lemaître de sesenta años atrás. Igual que Einstein había hecho antes, los cosmólogos de la época habían perdido interés en la constante cosmológica. Para desempeñar el papel requerido en el universo a medida, su valor tenía que ser fantásticamente bajo (10−120). Con un valor tan bajo, muchos físicos pensaron que se trataba de una señal de que su valor era, en realidad, cero: solo faltaba por descubrir un profundo principio de la física que forzase a que el valor fuese precisamente nulo, y algún día acabaríamos hallando ese nuevo principio de simetría. Hasta entonces, ignorémosla. Esta era la actitud habitual entre los físicos de partículas. Mientras tanto, los astrónomos mantenían siempre su escepticismo sobre parte de sus datos. Era fácil dejar que lambda dependiese de algo que al final desapareciera o se descubriera que era más incierto de lo que se pensaba. Incluso los que se tomaban Lambda-CDM más en serio eran prudentes, porque las pruebas de su presencia no eran directas. No estamos observando la aceleración del universo directamente en nuestros días, sino efectuando pequeñas correcciones debido a su contribución a otras observaciones del comportamiento del universo en el pasado.

La situación dio un vuelco espectacular en 1998. Dos grandes equipos de investigación, trabajando de forma independiente y dirigidos por astrónomos de fama mundial, hallaron la primera prueba de que la expansión del universo está actualmente acelerándose. Para sorpresa general, el proyecto High-z Supernova, dirigido por Adam Riess en la Universidad de Harvard, y el proyecto Supernova Cosmology, dirigido por Saul Perlmutter en los Lawrence Berkeley Laboratories de la Universidad de California-Berkeley, hallaron nuevas y espectaculares pruebas de que la expansión del universo empezó a acelerarse hace unos pocos miles de millones de años[428]. Era necesario extender la ley de Hubble hasta distancias más lejanas que nunca para poder rastrear el incremento de la velocidad de expansión en función de la distancia lo bastante lejos como para verificar si en algún momento empezaba a aumentar más rápido que la ley de velocidad proporcional a la distancia, un incremento que indicaría la presencia de aceleración.

Es fácil medir la velocidad con mucha precisión utilizando el corrimiento hacia el rojo de la luz, pero el problema es conocer las distancias a las fuentes de luz lejanas cuyas velocidades se están midiendo. Si una fuente parece tener un brillo promedio, ¿es porque es intrínsecamente tenue pero cercana, o es intrínsecamente brillante pero mucho más lejana? ¡Lo ideal sería tener una población cósmica de bombillas de 100 vatios! Se podría utilizar el telescopio para leer la etiqueta «100 vatios» de cada una de ellas, que indicaría su brillo intrínseco. Comparando esa cifra con el brillo aparente se podría deducir la distancia a la que cada bombilla se encuentra de nosotros. Por desgracia, no hay ninguna población de bombillas con etiquetas que se expanda al mismo tiempo que el universo. Lo que se hace es buscar objetos cuyo brillo intrínseco pueda determinarse (como el de las bombillas) observando algunas de sus propiedades físicas, como su ritmo de variación. Los astrónomos denominan a estos objetos «candelas estándar».

Estas nuevas observaciones de los dos equipos mencionados aprovechaban el hecho de que tanto los telescopios en la superficie de la Tierra como el telescopio espacial Hubble pueden ver explosiones de estrellas de un tipo muy especial, denominadas supernovas de Tipo Ia, a distancias muy grandes. Estas estrellas son buenas candidatas a candelas estándar, porque se cree que son el resultado de eventos cósmicos muy particulares y además se encuentran entre los objetos más brillantes del universo[429].

Cuando estrellas con una masa inferior a 1,4 veces la masa del Sol agotan su combustible nuclear e implotan bajo su propia atracción gravitatoria, se contraen hasta un tamaño aproximado al de la Tierra, un tamaño que se puede mantener por la presión contraria creada apretando los electrones en los átomos[430]. Este estado estable se denomina «enana blanca», y estos cadáveres estelares son muy numerosos en el universo. Un día, la agonía de nuestro Sol producirá uno de ellos.

Si una estrella es más pesada, entre 1,4 y unas 3 veces la masa del Sol, esta contrapresión electrónica no bastaría para resistir el aplastamiento gravitatorio de los átomos. Los electrones se verían presionados contra los protones en los núcleos atómicos y solo quedarían neutrones. Los neutrones se resisten a que los aprieten y, mientras la masa de la estrella no supere en tres veces la del Sol, la presión de los neutrones puede detener el aplastamiento gravitatorio y generar una estrella de neutrones estable, con una densidad 100 billones de veces superior a la del hierro. Como las enanas blancas, estas estrellas de neutrones son también muy comunes en el universo, y las que giran rápidamente se muestran como púlsares que emiten periódicamente radiación hacia nosotros a medida que giran, como si de faros se tratase. Pero si la estrella moribunda tiene una masa mayor de tres veces la del Sol, ninguna fuerza conocida de la Naturaleza puede detenerla. Eventualmente, esta masa caerá en una región tan pequeña que la luz no podrá escapar de ella. La contracción en curso será invisible para el universo exterior: se habrá formado un agujero negro.

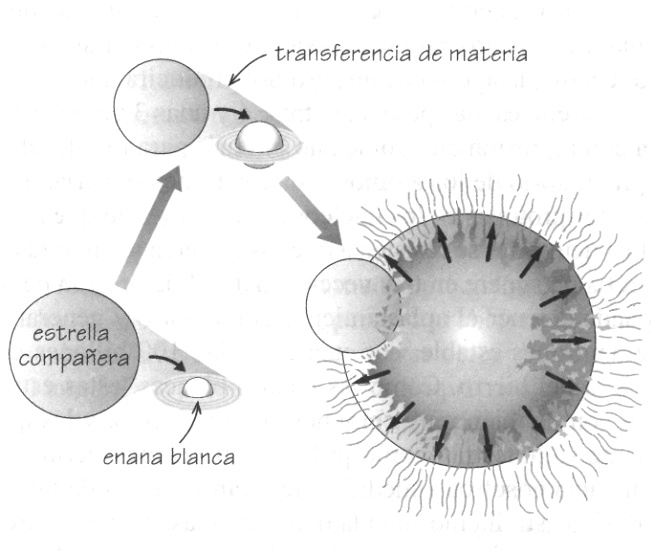

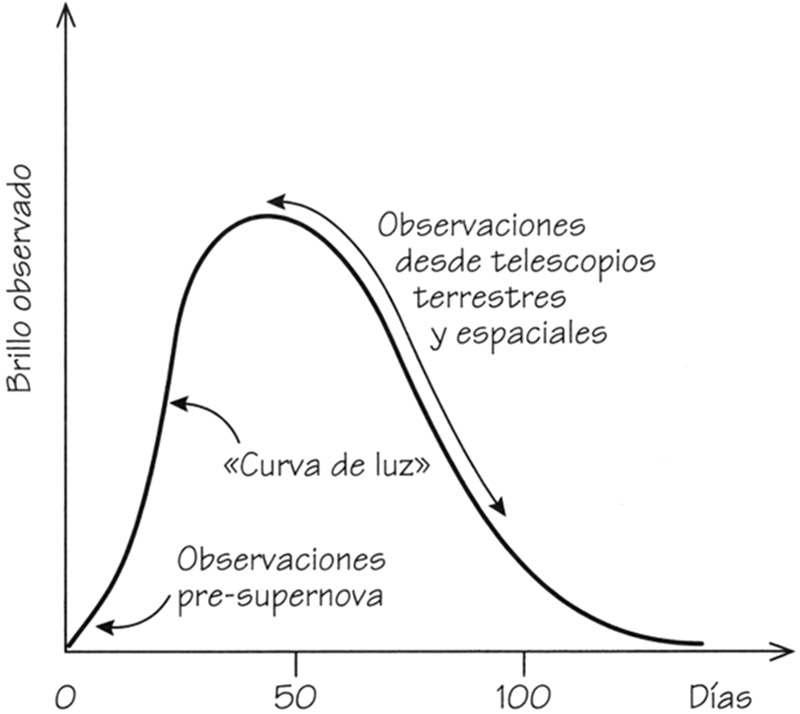

Alrededor de la mitad de las estrellas del universo están en parejas, orbitando alrededor de un centro de gravedad común. Si una de las estrellas muere y forma una enana blanca, puede seguir acreciendo materia de las regiones externas de su compañera. En última instancia, este canibalismo podría hacer que su masa superase el límite de 1,4 masas solares y la presión de los electrones ya no pudiese aguantar el aplastamiento gravitatorio. La enana blanca experimenta entonces una espectacular explosión termonuclear (Figura 12.1). Esta explosión ocurre en todos los casos en que la masa de la enana blanca supera el límite de 1,4 masas solares, y el pico de brillo de la explosión será siempre muy similar. Ese pico de brillo es de más de un millón de veces el brillo de nuestro Sol; una sola estrella que se hace tan brillante como toda una galaxia. Después de la explosión, la luz y sus colores pierden intensidad de una forma característica a lo largo de los meses siguientes. Esta «curva lumínica» de atenuación del brillo con el tiempo la determina principalmente la desintegración radiactiva del elemento níquel en los primeros días y semanas, y luego la desintegración del cobalto. En el estudio de la relación entre el brillo máximo y el ritmo de caída de la curva lumínica, los dos equipos compararon distintas supernovas y calcularon sus distancias relativas respecto de nosotros.

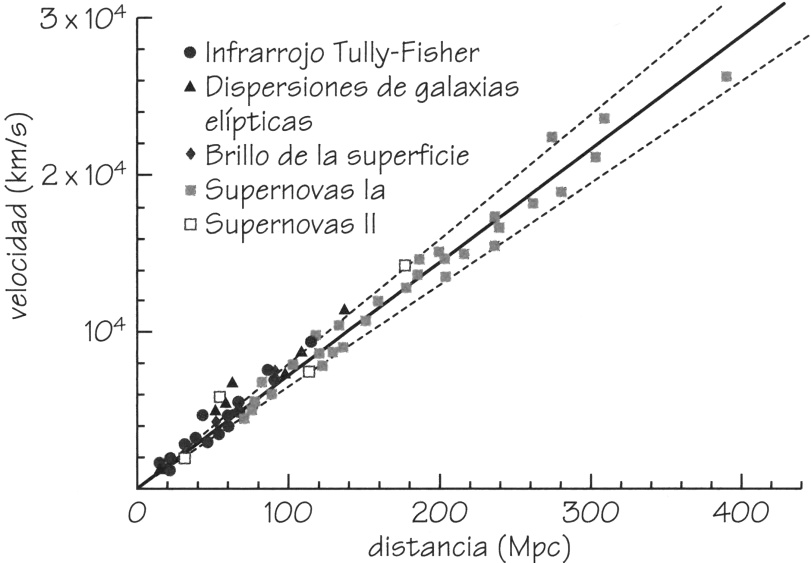

Tanto el equipo de Harvard como el de Berkeley utilizaron esta nueva herramienta para determinar distancias y extender nuestras mediciones de la ley de Hubble. En primer lugar utilizaron potentes telescopios terrestres para observar varios cientos de zonas del cielo nocturno con alrededor de un millar de galaxias cada una, en el período de luna nueva, cuando el cielo está más oscuro. Tres semanas después volvieron a inspeccionar las mismas zonas del cielo para ver si alguna de las estrellas había aumentado de brillo espectacularmente por haberse convertido en supernova. Como esperaban, hallaron alrededor de veinticinco supernovas que estaban empezando a brillar. A continuación siguieron la variación de su luz mediante telescopios terrestres y espaciales, observando cómo crecía hasta su máximo y luego caía hasta niveles anteriores a la explosión, y controlaron también los colores de la luz (Figura 12.2). Sorprendentemente, las formas de las curvas lumínicas que observaron eran similares a las de supernovas próximas del mismo tipo. Esto reforzó su confianza en que las supernovas que estaban viendo cerca del límite del universo visible eran intrínsecamente objetos del mismo tipo, y la debilidad relativa de su luz se debía únicamente al hecho de hallarse a una mayor distancia de nosotros.

FIGURA 12.1. Una supernova de Tipo Ia aparece cuando una estrella enana blanca acrece materia de una estrella compañera. Su masa se incrementa más allá del límite de Chandrasekhar y la enana blanca deja de poder resistir el empuje de la gravedad. La contracción provoca una explosión termonuclear que nosotros vemos en forma de supernova.

FIGURA 12.2. Curva de luz de una supernova tipo Ia. La variación del brillo observado hacia un máximo va seguida de un regreso regular al nivel de luz anterior a la explosión. En la práctica, el seguimiento de estas variaciones se lleva a cabo en diversos colores.

Cuando combinaron todos sus datos, ambos grupos llegaron de forma independiente a las mismas conclusiones. La forma de la ley de Hubble para la velocidad de expansión de las supernovas distantes en función de su distancia se curvaba hacia arriba (Figura 12.3). El universo estaba acelerando. Este descubrimiento se anunció públicamente por primera vez en enero de 1998, y desde entonces ha supuesto un foco de interés para la investigación astronómica; la base de datos de observaciones no deja de crecer, se estudian cuidadosamente los datos y los métodos de análisis de los dos grupos y se someten a un minucioso escrutinio todas las hipótesis acerca de las candelas estándar y del universo interpuesto a través del cual ha tenido que viajar la luz de las supernovas antes de alcanzar nuestros telescopios.

FIGURA 12.3. Ley de Hubble de velocidad de recesión en función de la distancia, incluyendo observaciones de supernovas recientes. La gráfica muestra las observaciones de velocidad en función de distancia, y la pendiente de la curva con mejor ajuste da una constante de Hubble de 72 km/s/Mpc.

El universo absurdo

Tenemos que aprender a entender este poco atractivo universo porque no tenemos otra opción […] Si no tuviese todos los datos de que dispongo y alguien viniese a mostrarme un universo así, le preguntaría qué es lo que ha estado fumando o le diría que se dejase de cuentos de hadas.

John Bahcall

Las consecuencias de estas observaciones de supernovas fueron enormes. Se trataba de la primera prueba directa de la aceleración del universo. Confirmaba las expectativas del modelo cosmológico Lambda-CDM con bastante precisión y demostraba que el tipo de aceleración antigravitatoria que invocaba la teoría del universo inflacionario en los primeros momentos de la expansión existe en realidad. La descripción más simple posible de la aceleración observada funcionaba muy bien. Si se restituía la antigua constante cosmológica de Einstein como un efecto antigravitatorio y se suponía que la expansión tenía lugar muy cerca del ritmo crítico, como predecía la teoría de la inflación, teníamos un universo que era como uno de los de Lemaître que mostraba la Figura 3.13, y coincidía con gran precisión con las observaciones.

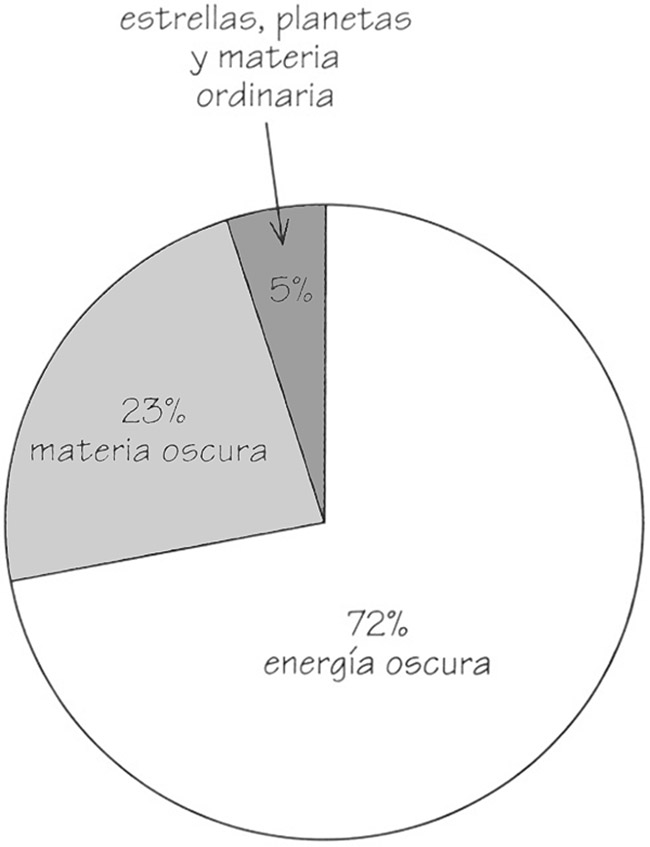

Aunque las observaciones quedaban bien explicadas con la introducción de un término simple de constante cosmológica en las ecuaciones de Einstein, los cosmólogos sabían que la situación podía fácilmente ser más compleja. Podía haber alguna tensión antigravitatoria más exótica en el universo, como las que se habían explorado como candidatas a impulsar la inflación en los primeros tiempos de la historia del universo. En consecuencia, se introdujo el término «energía oscura» para describir esta misteriosa fuente de energía. Podía ser que contribuyese con una densidad constante a la densidad total del universo (como la constante cosmológica) o podía cambiar con el tiempo y acabar remedando el efecto de una verdadera constante cosmológica en el pasado más reciente. Increíblemente, para explicar las observaciones necesitamos que alrededor del 72 por ciento de la energía del universo resida en esta misteriosa energía oscura, y el otro 28 por ciento en forma de otra materia. De ese 28 por ciento, solo el 5 por ciento está en la forma de materia ordinaria; el resto, un 23 por ciento, está en forma de algún tipo de materia oscura fría no atómica cuya identidad exacta aún no se ha establecido, pero que probablemente sea un nuevo tipo de neutrino que podría hallarse próximamente en el LHC del CERN (Figura 12.4).

FIGURA 12.4. Diagrama de tarta en el que se muestra la composición actual del universo. La mayor parte del material gravitatorio está en la forma de una «energía oscura», que es la responsable de la aceleración del universo en el pasado reciente. El material restante consiste en materia oscura y materia luminosa. Es muy probable que la materia oscura esté compuesta de nuevos tipos de partículas que interaccionan muy débilmente, similares a los ya conocidos pero mucho más pesadas. Esperamos que se confirme su existencia en los experimentos del Gran Colisionador de Hadrones (LHC) de Ginebra, y luego detectarlas directamente en detectores subterráneos cuando pasen a través de la Tierra.

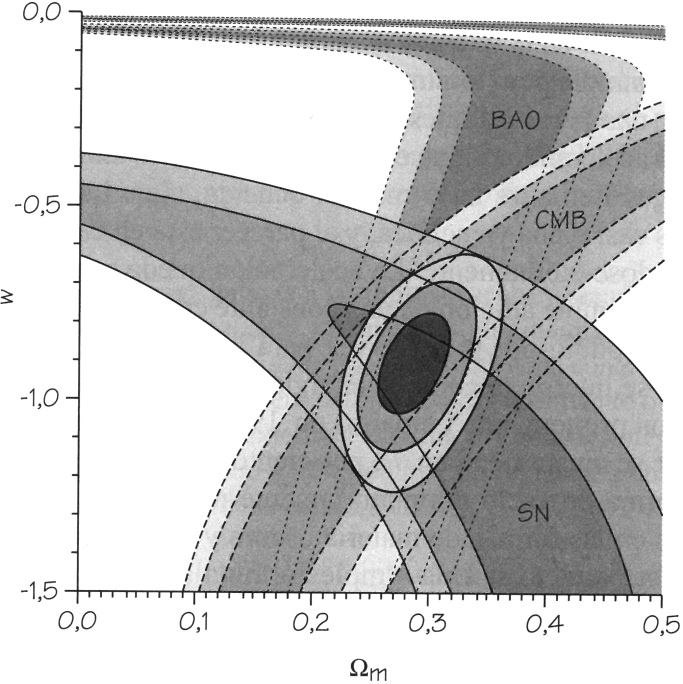

A lo largo de los últimos doce años, los argumentos a favor de la aceleración del universo se han hecho cada vez más fuertes, ya que han aparecido más pruebas indirectas que los apoyan y que precisan los detalles sobre la cantidad de energía oscura necesaria para impulsarla. Las pequeñas fluctuaciones en la radiación de fondo presente en todo el universo han sido observadas en mayor detalle por diversos telescopios, tanto espaciales como terrestres. La aceleración modifica el aspecto de la geometría pasada del universo (las cosas eran más pequeñas de lo que se pensaba en cualquier momento específico del pasado) y nos permite poner límites en la cantidad de cambio que puede haber tenido lugar. Esto limita la cantidad total de energía oscura y de materia oscura que el universo puede contener. Recientemente ha surgido también una tercera nueva restricción. Las variaciones en la densidad que acaban por formar los cúmulos y galaxias en el universo deberían aflorar de la época del universo dominada por la radiación en forma de inmensas ondas sónicas. Cuando la temperatura cae hasta unos 3000 grados, los electrones se liberan de dispersarse con la radiación y la velocidad del sonido a la que viajan las gigantescas ondas sónicas se reduce drásticamente. Las ondas conservan el recuerdo de su tamaño en el momento en que esto sucedió. En consecuencia, se esperaba que se conservasen pequeñas ondulaciones en el patrón de acumulación de la materia en el universo, con un potente rasgo adicional de más de 120 megapársecs grabado por los residuos de las ondas sónicas. Este efecto tiene el poco elegante nombre de «oscilación bariónica acústica», porque los protones y los neutrones que componen los núcleos de la materia atómica ordinaria (el 5 por ciento del total) se denominan colectivamente bariones. Esto nos ofrece nueva información acerca de los tamaños de las galaxias en el momento del pasado en que la exploración astronómica las ve. Si combinamos la información observacional de las supernovas, de la radiación de fondo y de las oscilaciones acústicas, obtenemos una asombrosa convergencia. Por casualidad, las incertidumbres y certidumbres en cada uno de estos grupos de observaciones son casi ortogonales, de modo que su combinación restringe las posibilidades de forma espectacular. Esto se ilustra con gran claridad en la Figura 12.5, donde las incertidumbres (representadas por elipses que indican las áreas permitidas con una credibilidad del 68,95 y 99,7 por ciento a medida que se hacen más pequeñas) se reducen en gran parte mediante la combinación de las diferentes pruebas.

FIGURA 12.5. La fracción, ΩΛ, del universo que puede encontrarse en forma de energía oscura en comparación con la fracción, Ωm, que puede hallarse en otras formas de materia, tanto luminosa como oscura. Se muestran las restricciones debidas a las observaciones de supernovas (SNe), las fluctuaciones de temperatura de la radiación de fondo de microondas (CMB) y los efectos de la oscilación bariónica acústica (BAO) en la distribución de materia. Las tres zonas sombreadas representan las regiones del 68 por ciento (sombra más oscura), 95 por ciento (sombreado medio) y 99,7 por ciento (sombreado claro) de credibilidad estadística. La región superpuesta representa el 72 por ciento de energía oscura que se muestra en la Figura 12.4.

El eje vertical representa la proporción del universo en forma de energía oscura. En el horizontal se muestra la proporción del resto de materia. Todos los conjuntos de datos se superponen en una pequeña región alrededor de 0,72 y 0,28 para estas dos cantidades[431]. La superposición converge también alrededor de un universo espacialmente plano con una curvatura próxima a cero, que es lo que se debe esperar en caso de inflación en nuestro pasado.

FIGURA 12.6. Las restricciones en w, la proporción entre presión y densidad de la energía oscura, en función de la fracción del universo en forma de materia Ωm, a partir de observaciones de supernovas, la radiación de fondo de microondas (CMB) y las oscilaciones bariónicas acústicas (BAO).

Esta imagen se ha creado con la hipótesis de que la energía oscura queda descrita de forma exacta por la constante cosmológica de Einstein. Eso significa que aporta la misma densidad en todos los puntos temporales, y el eje vertical muestra una gama con todos los valores que podría tener. Sin embargo, la energía oscura podría ser más exótica y modificar ligeramente su densidad con el tiempo, como las otras formas de materia. Este sería el caso si la relación[432] de la presión ejercida por la energía oscura respecto de su densidad de energía no fuese igual a −1. Cuando esta relación, w, es igual a −1, la densidad es constante, y su contribución es exactamente la misma que la constante cosmológica que se muestra en la Figura 12.6. Si se desvía de −1, debe de haber un lento cambio de la energía oscura con el tiempo. Supongamos que se permite esa posibilidad y volvemos a analizar todos los datos. Ahora podemos examinar de nuevo dónde convergen los datos dentro de los perfiles de credibilidad del 68, 95 y 99,7 por ciento. La relación presión-densidad, w, se representa verticalmente, con la fracción del universo que no está en forma de energía oscura en el eje horizontal. Si nuestra hipótesis original sobre la constante cosmológica hubiese sido exacta, los datos habrían convergido en el punto en que w es igual a −1 y la fracción de materia Ωm es igual a 0,28.

Actualmente, el mejor cálculo a partir de todos los datos es que, con una confianza del 95 por ciento, la relación entre presión y densidad de energía se encuentra entre −1,097 y −0,986. El caso más simple de la constante cosmológica exigiría que w = −1, y las observaciones lo apoyan sólidamente. En consecuencia, se suele suponer que la energía oscura tiene esta forma para simplificar.

La situación en la que nos encontramos ahora es, en muchos sentidos, muy simple pero totalmente misteriosa. El universo visible, que podría ser una parte infinitesimal de un multiverso infinitamente variado, está acelerando. Sigue el camino del modelo simple planificado por Georges Lemaître hace más de ochenta años. La geometría del espacio es casi plana y euclídea, y al parecer está en camino de seguir expandiéndose eternamente. La aceleración queda muy bien descrita mediante la simple adición de una constante cosmológica del tipo que Einstein introdujo por primera vez para luego rechazarla, y que actualmente se interpreta como la energía del vacío del universo, como sugirió por primera vez Lemaître en 1934[433]. El universo resultante que mejor se ajusta tiene un 72 por ciento de su densidad de energía en esta forma de vacío gravitatoriamente repulsivo, y el restante 28 por ciento en las formas de materia oscura y materia luminosa gravitatoriamente atractiva. Una simple fórmula matemática describe la evolución de la expansión del universo en el tiempo[434]. En la Figura 3.13 vimos su forma característica. En las primeras fases, el universo se expande como si no hubiera energía del vacío porque es insignificante. A medida que pasa el tiempo la expansión empieza a cambiar el ritmo y pasa de deceleración a aceleración cuando el universo se ha expandido hasta alrededor de un 57 por ciento de su tamaño actual. Poco después, la densidad de energía en otras formas de materia cae por debajo de la de la energía del vacío cuando la expansión alcanza alrededor del 73 por ciento de su tamaño actual, hace unos 4500 millones de años (un momento bastante próximo al de la formación de la Tierra, aunque nadie ha sugerido que esto sea algo más que una coincidencia total[435]).

Una de las propiedades más notables del universo acelerado es su futuro. En 1986, Frank Tipler y yo mismo demostramos que cualquier operación de proceso de información efectuada por cualquier tipo de ordenador o «cerebro» acabaría por cesar en el futuro. La formación de estrellas y galaxias se extinguirá. Este universo se expande demasiado rápido para que los procesos físicos puedan seguirle el ritmo. El universo futuro parece ser un cementerio cósmico de estrellas muertas y partículas elementales aisladas. Y estarán realmente «aisladas». La aceleración se traduce en que habrá un horizonte más allá del cual ningún observador podrá ver. Es como estar en el interior de un gran agujero negro. La luz no puede competir con la aceleración para llegar a nosotros desde grandes distancias. El primero que se percató de esta extraña situación fue Arthur Eddington en 1933. En su famoso libro de divulgación La expansión del universo escribió acerca de este fenómeno:

[…] la distancia de una galaxia a la siguiente acabará siendo tan grande, y la recesión mutua tan rápida, que ni la luz ni ninguna otra influencia causal podrá pasar de la una a la otra. Se perderá toda conexión entre las galaxias; cada una de ellas será un universo independiente que no recibirá la influencia de nada externo a él. Concebir una desintegración así es una verdadera pesadilla, a pesar de que no representa una amenaza concreta para el destino de la humanidad[436].

Si te preocupa que el multiverso introduzca partes no observables del universo en nuestra imagen del cosmos, quizá también debería preocuparte que incluso un universo de «una sola oportunidad» contiene regiones que no podemos ver ahora ni siquiera en un futuro infinito.

Y sin embargo, a pesar de que uno de los universos simples de Einstein y nuestras observaciones coinciden tan bien, la situación es terriblemente inquietante. Hay dos formas de energía implicadas en el control de la expansión del universo desde hace 5000 millones de años. Cuando la energía del vacío constante toma el control, su influencia se hace cada vez mayor, mientras que la de todas las formas de materia y radiación disminuye rápidamente a medida que el universo se expande. Tipler y yo demostramos también que esto tiene importantes consecuencias[437]. Una vez que el universo empieza a acelerar, el crecimiento de las irregularidades causadas por el proceso de inestabilidad gravitatoria descubierto por Newton, Jeans y Lifshitz se desactiva. Es incapaz de seguirle el paso al aumento del ritmo de expansión. Si no se han formado galaxias al llegar este período de cambio, ya nunca se formarán. Sin galaxias no se pueden formar estrellas estables ni producir carbono y el resto de bloques de construcción de la vida y de los observadores.

El universo desconcertante

[…] la constante cosmológica ha sido como un par de polainas del abuelo, que a veces se llevan a las fiestas de disfraces; pero estos nuevos resultados sugieren que no solo se van a volver a poner de moda, sino que han impuesto su presencia.

Robert Kirshner

El descubrimiento de la existencia de una tensión de constante cosmológica en el universo con un valor que la hace actualmente dominante supuso un shock para muchos astrónomos y para casi todos los físicos de partículas. Si expresamos la constante cosmológica en unidades del valor máximo que podría tener se convierte en un puro número, una constante de la Naturaleza que caracteriza lo baja que ha resultado ser la energía del vacío del universo en una escala de cero (el mínimo) a uno (el máximo).

Hasta la aparición de las primeras pruebas directas procedentes de la observación de supernovas, las sugerencias indirectas de que la mejor forma de conciliar las dispares observaciones de la radiación de fondo y la agrupación de galaxias era una constante cosmológica no convencían a los físicos de partículas. Sus teorías les hacían sospechar que existía, pero el valor que esperaban era de 1 en una escala de 0 a 1. Por desgracia, el valor más alto que las observaciones permitían antes de los datos de las supernovas en 1998 era, como máximo, 10−120, tan cerca de cero como uno puede imaginar. La mayor parte de los físicos de partículas llegaron a la conclusión de que el valor era cero y de que debía de haber algún importante principio de la física de altas energías esperando a ser descubierto que lo justificase. Cuando las observaciones de las supernovas confirmaron que realmente existía una constante cosmológica en el universo, o algo parecido a efectos prácticos, con ese extraño y minúsculo valor de 10−120, la gente empezó a rascarse la cabeza con perplejidad. ¿Por qué este valor? ¿Qué es lo que hace que se elija este reducidísimo valor que es 10120 veces menor al que los físicos de partículas creen que sería el más natural?

El valor es doblemente, e incluso triplemente, enigmático, porque si hubiese sido unas 10 veces mayor, meramente 10−119, no se podrían haber formado galaxias ni estrellas. Es más, si se alzan los brazos y se dice que el universo simplemente empezó con ese minúsculo valor de 10−120, el problema no se resuelve. Hay una serie de épocas especiales durante los primeros tiempos de la historia del universo en las que las distintas fuerzas de la Naturaleza se salen de la formación y prosiguen con intensidades distintas. Cada vez que sucede una cosa así, la constante cosmológica se reinicia a un valor mucho mayor que el valor inicial de 10−120. Cualquier proceso físico que pueda explicar el actual valor excepcionalmente bajo deberá tener un gran alcance hacia el futuro de la historia cósmica en distintos momentos, para prever las consecuencias de distintas transiciones en diferentes épocas y cancelar las contribuciones por venir. No conocemos ningún efecto físico que actúe así.

Hasta ahora, no hay explicación para este extraño valor de la constante cosmológica que denominamos «energía oscura» del universo. Podría haber una parte totalmente nueva de la física de la gravedad, o de su homóloga cuántica, que de algún modo aporte una explicación. Los físicos han empezado a explorar ampliaciones de la teoría de la gravedad de Einstein agregándole nuevos tipos de geometría, de modo que la curvatura del espacio creada por la presencia de materia sea ligeramente distinta y crezca a medida que el universo se hace más grande[438]. Este era un tipo de cambio esperado cuando retrocedemos hasta las condiciones extremas de la singularidad inicial e intervienen los efectos de la cosmología cuántica. Pero nadie esperaba realmente hallar que esta clase de efectos cambiasen la teoría de Einstein en etapas muy avanzadas de la historia del universo, en las que la densidad de materia es muy baja, las fuerzas gravitatorias muy débiles y no deberíamos tener que preocuparnos de efecto gravitatorio cuántico alguno. Este tipo de modificaciones pueden ser muy artificiosas para crear una aceleración tardía[439], pero por desgracia la mayoría generan efectos en otros lugares que no podemos ver. Los que sobreviven a este escrutinio tienen un aspecto tan poco natural como la simple constante cosmológica. Esta es una de las fronteras de la cosmología moderna.

Es bastante decepcionante que, hasta el momento, la investigación en teorías de cuerdas o en la teoría M no ha servido de ayuda con este problema en absoluto. Quizá, solo quizá, estamos buscando en el lugar equivocado y no hay una explicación convencional para la aceleración del universo o para la constante cosmológica. Quizá la constante cosmológica la determine de forma aleatoria algún proceso cuántico en el paisaje del multiverso. Su valor podría decidirse al azar de un universo a otro. Es posible que nos hallemos en uno de los universos del multiverso en los que el valor sea lo bastante bajo como para permitir la formación de galaxias y estrellas. Aunque este resultado sería un desengaño para muchos investigadores, quizá tengamos que aprender a asumirlo. A los que, horrorizados, retroceden y piensan que esto representaría una derrota para el método científico, les ofrezco una pequeña historia de «ciencia ficción real».

Imaginemos que estamos en el año 1600, intentando persuadir a Johannes Kepler de que no es necesario que su teoría del sistema solar prediga el número total de planetas que contiene. Para Kepler[440], el número de planetas era una manifestación de las más profundas simetrías matemáticas de la Naturaleza. La idea de que un modelo matemático del sistema solar no lo determinase de forma única y completa habría sido un anatema, una renunciación del método científico.

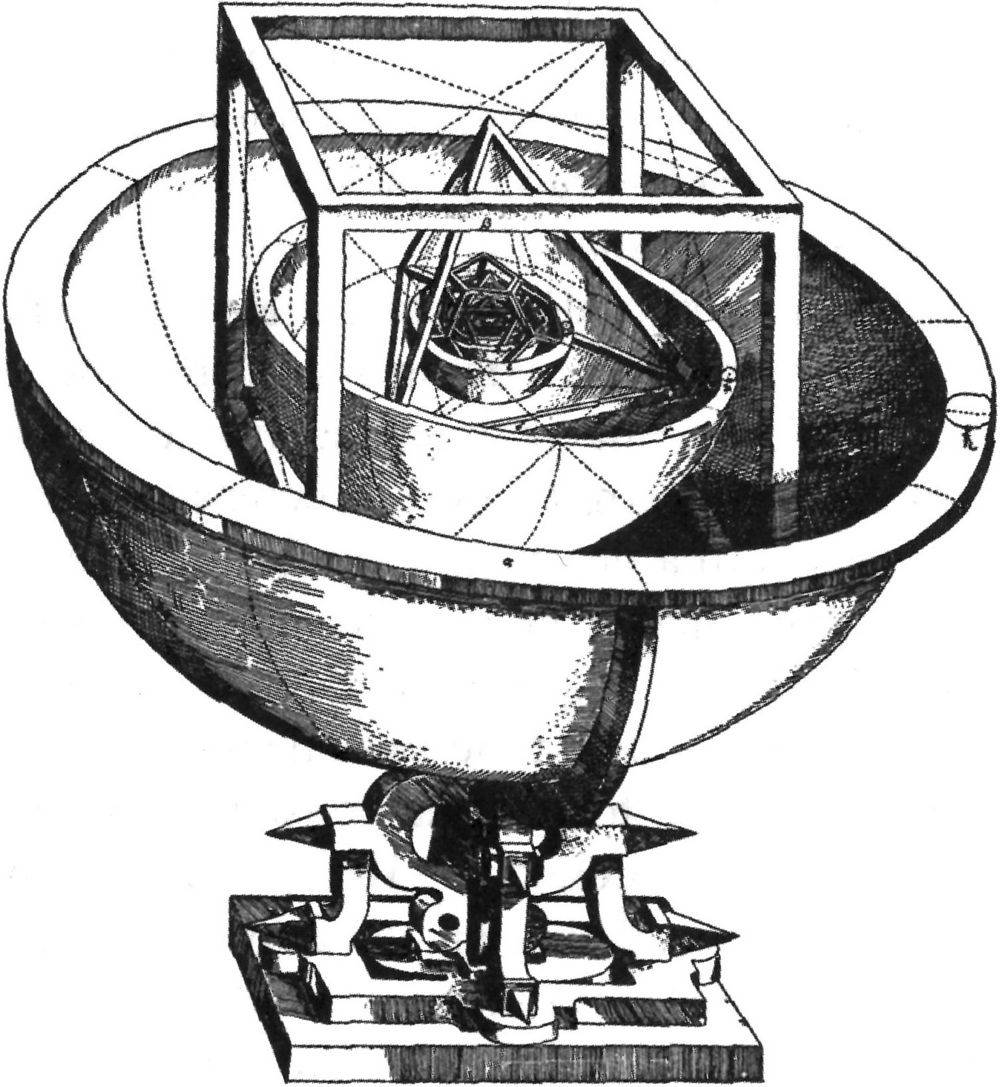

Kepler había descubierto que cada uno de los cinco sólidos platónicos se podía inscribir y circunscribir de forma única mediante esferas. Si se anidaban unas dentro de otras como capas de una cebolla, las esferas generarían seis capas, correspondientes a los seis planetas conocidos: Mercurio, Venus, la Tierra, Marte, Júpiter y Saturno. Poniendo los sólidos platónicos en el orden correcto —octaedro, icosaedro, dodecaedro, tetraedro y cubo—, Kepler halló que las esferas anidadas podían asignarse a intervalos correspondientes a la trayectoria (supuestamente) circular de cada planeta alrededor del Sol. Su dibujo se muestra en la Figura 12.7.

Actualmente, ningún astrónomo planetario en sus cabales intentaría predecir cuántos planetas debería haber en el sistema solar, ni atribuir significado profundo alguno a su número, como hacía Kepler. Ese número no es más que un accidente histórico, resultado de una concatenación de fusiones y accidentes ocurridos durante la historia primigenia del sistema solar cuyo resultado podía haber sido distinto con toda facilidad. Se trata de un efecto aleatorio. El astrónomo planetario está en cambio interesado en explicar las tendencias en la composición y el tamaño de los planetas en función de la distancia al Sol, así como en muchos otros aspectos de su dinámica.

FIGURA 12.7. El modelo profundamente platónico del sistema solar de Johannes Kepler, tomado de su primera gran obra sobre astronomía, Mysterium Cosmographicum («El misterio cosmográfico»), del año 1600.

¿Y si la constante cosmológica es una simple cifra, como el número de planetas? Que creamos que sea una propiedad fundamental del universo no significa que esté determinada, de forma única e inevitable, por las leyes de la Naturaleza. Podría ser un resultado totalmente aleatorio de esas profundas leyes: un accidente, aunque muy importante desde nuestro punto de vista. No se podría afirmar nada más acerca de ella. Sin embargo, igual que en el caso del sistema solar, ese no es el final de la historia. Habrá otros aspectos del universo visible que sean predecibles, y debemos averiguar cuáles son para poder comprobar nuestras teorías y explicaciones. Quizá los cosmólogos del futuro lejano miren hacia atrás a nuestras inquietudes sobre cómo hallar una explicación para la constante cosmológica de la misma forma que nosotros miramos hacia atrás a la preocupación de Kepler con el número de planetas del sistema solar.

Pero podría haber un rayo de esperanza. Hace muy poco tiempo, Douglas Shaw y yo mismo hemos desarrollado un enfoque totalmente nuevo para este problema[441], que agrega una nueva ecuación a las halladas por Einstein para permitir que la constante cosmológica se comporte como una forma de energía cambiante si es necesario, y para garantizar que una imagen no cuántica del universo es visible en épocas tardías. Esto facilita una bella predicción: si eres un observador en el universo en un tiempo tu después de iniciarse su expansión, siempre observarás los efectos de una constante cosmológica cuyo valor viene dado por (tp/tu)2, donde tp = 10−43 s es el tiempo fundamental de Planck. Dado que la edad actual del universo visible es tu = 4,3 × 1017 s, esperamos ver una constante cosmológica con un valor de aproximadamente 0,5 × 10−121, que es el que vemos[442]. Sorprendentemente, no necesitamos nuevas formas de energía oscura, ni modificaciones cuánticas de las ecuaciones de Einstein, ni un multiverso de todos los universos posibles en el que la selección antrópica exige valores muy pequeños de la constante cosmológica. Y lo que es más importante, esta nueva teoría hace una predicción definida del valor de la magnitud actual de la curvatura espacial del universo visible: esta curvatura debe ser positiva, y el valor observable[443] de su energía efectiva debe ser igual a −0,0056. Las observaciones actuales muestran que esta energía de curvatura se encuentra entre −0,0133 y +0,0084, pero los mapas de la radiación de fondo de microondas elaborados por el satélite Planck de la Agencia Espacial Europea, en combinación con otras observaciones tenidas en cuenta en la Figura 12.5, mejorarán considerablemente la precisión, y pronto podremos confirmar o refutar esta predicción tan precisa.

Nuestra historia ha recorrido un largo camino. Empezamos preguntándonos cuán difícil es comprender el cielo. Vimos que era muy complejo entender las estrellas y decidir si existían otras galaxias. La teoría de la relatividad general de Einstein de 1915 marcó un hito en la visión de nuestro universo y en la posibilidad de otros. Por primera vez podíamos predecir y estudiar universos enteros, comprender sus propiedades generales y elegir entre ellos. Hemos seguido el proceso de descubrimiento que ha hallado cada vez más soluciones de las ecuaciones de Einstein y ha revelado universos con una multitud de propiedades inesperadas. Hemos visto cómo se han utilizado para comprender las observaciones astronómicas o para expresar visiones filosóficas sobre cómo debería ser el universo.

El actual paradigma cosmológico es el más longevo que se ha visto. Es la imagen del universo inflacionario, basada en un brote de expansión acelerada en el pasado remoto del universo, y su correcta predicción del patrón especial de minúsculas variaciones que vemos en la radiación como rastro de las primeras etapas de la expansión. La combinación de la potencia de los superordenadores para simular las complejidades de la agrupación de galaxias con las observaciones de extraordinaria sensibilidad de los nuevos telescopios ha trazado un mapa del universo que es comprensible, pero desconcertante.

Se nos pide que aceptemos que nuestro universo forma parte de un infinito multiverso de universos reales con propiedades distintas. Nuestro universo puede ser especial en aspectos esenciales para nuestra propia existencia y la de otras formas de vida inteligente. Hoy, nuestro universo muestra un segundo brote de expansión acelerada que se inició hace menos de 5000 millones de años.

Copérnico nos enseñó que nuestro planeta no se encuentra en el centro del universo. Quizá ahora tengamos que aceptar que ni siquiera nuestro universo se encuentra en el centro del Universo.