8

El principio para principiantes

Para hacer una tarta de manzana partiendo de cero, se debe antes crear el universo.

Carl Sagan

Universos singulares

La singularidad es siempre una pista. Cuanto más monótono y corriente…

Arthur Conan Doyle

Casi todos los universos que hemos descrito tenían una sorprendente propiedad. «Empezaban» a un tiempo finito de nuestro pasado, en el que poseían una densidad infinita. Fue este inicio singular lo que tanto repugnaba a los creadores del universo de estado estacionario y lo que los motivó a buscar una alternativa que no «empezase» a existir en ningún momento histórico especial. Mucho tiempo antes, Richard Tolman había intentado eludir la inevitabilidad de un principio imaginando que los ciclos de expansión y contracción de un universo cerrado eran eternos, como una pelota que rebota. Esta explicación exigía una suspensión de la incredulidad en cada momento en que el universo rebotaba, porque la teoría de Einstein no podía seguir siendo válida a densidades y temperaturas tan enormes. Desde luego, no se puede llevar el universo hasta un tamaño cero y una densidad infinita y esperar que todo siga funcionando sin cambios.

Cuando se hallaron los primeros universos a partir de las ecuaciones de Einstein hubo distintos puntos de vista, generalmente escépticos, acerca del aspecto de un principio del universo con densidad infinita. Al principio, Einstein pensó que era simplemente una consecuencia de excluir la presión de las propiedades de la materia en el universo. Si se consideraba la presión, pensaba que todos los intentos de hacer retroceder el universo en el tiempo acabarían llegando al punto en el que la presión sería lo bastante alta como para detener cualquier compresión, y que el universo rebotaría hacia la expansión. Es como intentar comprimir un globo a un volumen cada vez más pequeño. La presión ofrece resistencia y acaba por detener la contracción.

Por desgracia, la intuición de Einstein no funcionó en este caso. En su teoría de la gravedad, todas las formas de energía gravitan, incluida la presión. Paradójicamente, si se incluye la presión, la compresión hasta el tamaño cero no se detiene, sino que en realidad ayuda a la contracción y hace que el momento de compresión infinita suceda antes: el efecto gravitatorio de la presión acentúa la compresión gravitatoria.

A continuación, Einstein se preguntaba si la densidad infinita era solo una consecuencia de considerar que los universos se expandían con una perfecta simetría. Si se invertía esta expansión esférica, todo acababa coincidiendo simultáneamente en un punto del pasado; sin embargo, si la expansión no era perfectamente esférica, las cosas podían «esquivarse» unas a otras al recorrer la expansión hacia atrás, y el evento de densidad infinita quedaría desenfocado y podría evitarse. Desde el punto de vista de Einstein[265], era un evento «ilusorio», punto de vista que compartían otros destacados cosmólogos, como Robertson[266] y De Sitter[267], a principios de la década de 1930.

Pronto se demostró que esta simple intuición, provocada por concebir el mundo como Newton, era falsa. En 1932, Lemaître estudió cómo sería un universo no esférico y anisótropo, y demostró que tenía un principio infinito en el pasado, como los isótropos[268]. El universo anisótropo que formaba parte del grupo de universos no uniformes de Kasner y Tolman también mostraba el mismo big bang infinito en el pasado[269]. Sin embargo, quizá hubiese asimetrías más complicadas, como la rotación, que podían evitar que el universo hubiese experimentado una densidad infinita en el pasado, un evento que finalmente se acabaría denominando «singularidad» inicial.

Esta infinitud es asombrosa. En lugares específicos de la superficie de la Tierra se pueden hallar rocas de más de 4000 millones de años de edad; las formas más simples de vida bacteriana tienen una edad de unos 3000 millones de años, y nuestros antepasados humanos modernos surgieron hace unos 200 000 años. La Tierra y el sistema solar no son mucho más viejos que esas rocas: alrededor de 4600 millones de años. Sorprendentemente, la expansión del universo sugiere que, si retrocedemos hasta un momento solo tres veces anterior —hace 13 800 millones de años[270]—, no habría ni tiempo, ni universo, ni nada en absoluto. Es una afirmación sensacional. Al parecer, estamos bastante cerca del principio de todo lo que existe.

A pesar del descubrimiento de que no bastaba con presiones y asimetrías para exorcizar la singularidad inicial, a principios de la década de 1960 surgió un influyente punto de vista que afirmaba que esta singularidad no era una característica física de los modelos de universo, de modo que no era necesario preocuparse por su realidad física. Un grupo de físicos rusos, inspirados por Landau y dirigidos por Evgeny Lifshitz, sostenían que la singularidad del big bang, con su densidad infinita y su condición de principio del tiempo, era totalmente ficticia y más bien inocua[271]. Utilizando una analogía conocida, pensemos en un modelo del globo terráqueo. El globo estará cubierto por una red de líneas de latitud y longitud que se utilizan para etiquetar de un modo único cada uno de los puntos de la superficie terrestre. Los llamamos «coordenadas» porque nos permiten co-ordenar distintos lugares de la Tierra. Si miramos hacia los polos Norte y Sur, veremos que las líneas de longitud convergen y, finalmente, se acaban intersecando en los polos: las coordenadas del mapa han acabado por degenerar en una especie de «singularidad». Esto no significa que haya ocurrido nada peculiar en la superficie de la Tierra. Simplemente hemos elegido esas coordenadas para trazar el mapa de la superficie. Siempre podemos cambiar a un sistema diferente cuando nos aproximemos a los polos; de este modo, nuestro mapa no tendrá fallos en su representación co-ordenada.

Esto es lo que Lifshitz y sus colegas argumentaban que sucedía al rastrear nuestros universos en expansión hacia atrás en el tiempo. El big bang no era más que una inocua singularidad de mapa creada por una elección errónea de coordenadas para describir el universo[272]. Cuando nos encontramos con esa singularidad ficticia, no tenemos más que cambiar a una nueva descripción, y a otra distinta si eso no funciona. El grupo ruso llegaba pues a la conclusión de que la singularidad del big bang no era físicamente real. No era el principio del universo. Lamentablemente, se acabó comprendiendo que eludir la singularidad mediante una serie de cambios de coordenadas en el mapa era también una ilusión, ya que evita preguntarse qué sucede si se hace un cambio de sistema de coordenadas tras otro. Si se explora con detalle este aspecto, se acaba hallando que la singularidad física real se conserva, del mismo modo que no se puede eliminar un agujero real en la superficie de la Tierra únicamente con el cambio de las coordenadas del mapa.

Todo esto creó una situación confusa a principios de la década de 1960, situación que obligó a los cosmólogos a plantearse de un modo más cuidadoso el significado de «singularidad». Si pensamos en un modelo de universo en cualquier punto del tiempo como una gran lámina de espacio, podemos localizar las singularidades en esa lámina preguntándonos en qué puntos la densidad se convierte en infinita. Supongamos ahora que recortamos esos puntos y los eliminamos. Lo que nos queda es una nueva (y perforada) lámina de espacio que describe un universo perfectamente válido y sin singularidades. Pero esto es como hacer trampa: el universo perforado debe de ser casi singular en un sentido u otro, ¿no? Pero, si hallamos un universo libre de singularidades, ¿cómo sabemos que nuestro método para buscarlas y describirlas no ha «cortado» sin querer las singularidades reales de esta forma más bien artificial?

Charles Misner propuso una respuesta en 1963, que cambió la forma de concebir las singularidades de los cosmólogos[273]. La idea era abandonar la noción tradicional de singularidad como un lugar en el que la densidad de materia, o alguna otra cualidad física, se hace infinita. En vez de eso, decimos que tiene lugar una singularidad si alguna trayectoria en el espacio y en el tiempo de cualquier partícula de materia o rayo de luz (su «historia») se interrumpe y no puede proseguir.

¿Qué puede ser más «singular» para un viajero que se mueva a lo largo de una de estas trayectorias que esta experiencia de Alicia en el país de las maravillas? Al final de su trayectoria nuestro rayo de luz llega al límite del espacio y del tiempo. Deja de ser.

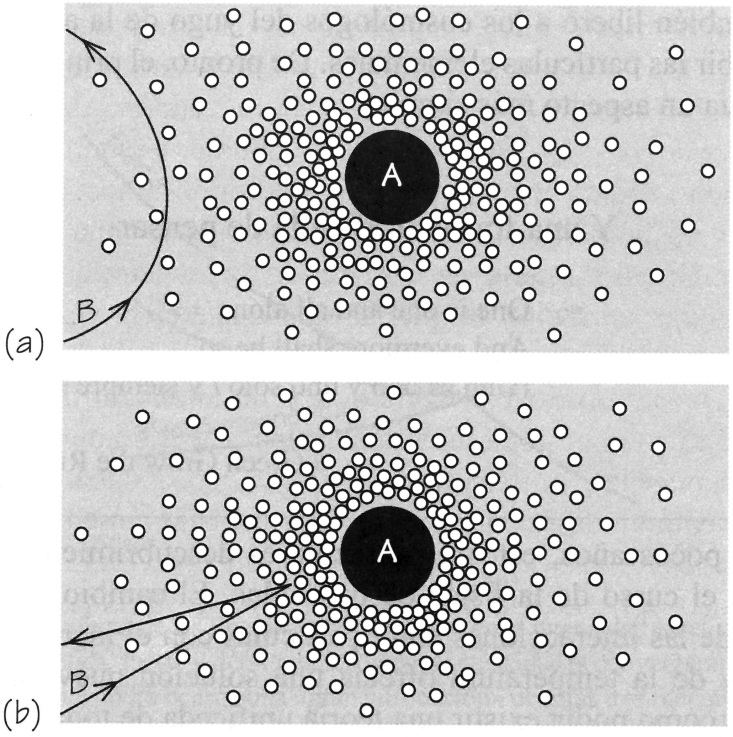

La elegante característica de esta forma simple de definir una singularidad es que si un atributo físico, como la energía o la densidad de materia, se hace infinita en algún punto, la trayectoria del rayo de luz se detendrá, porque en ese punto el espacio y el tiempo quedan aniquilados. Pero si este peligroso lugar ha sido extirpado sin darse cuenta del mapa del universo, la historia del rayo de luz seguirá llegando a su fin al alcanzar el perímetro del agujero que quede después de la eliminación (Figura 8.1).

Esta representación de las singularidades como el límite del espacio y del tiempo es tremendamente útil, ya que evita las cuestiones acerca de la forma del universo que tanto habían preocupado a Einstein, y elude las ambigüedades introducidas por los cambios de coordenadas del mapa. Si un universo es no-singular, entonces debe ser posible seguir indefinidamente hacia el pasado todas las posibles historias seguidas por las partículas y los rayos de luz: ni una sola de ellas debe tener un punto final en el pasado. En un universo no-singular no hay agujeros, fronteras ni puntos ausentes.

FIGURA 8.1. Dos láminas que representan universos en los que las trayectorias de los rayos de luz tienen fin. En (a) hay un orificio, y el rayo de luz toca su frontera. En (b), el rayo de luz se tropieza con un lugar de infinita densidad de materia en el que el espacio-tiempo se destruye.

A pesar de su simplicidad, esta provoca numerosas cuestiones muy complicadas. Podría ser que cada vez que una historia pasada se detiene haya también una densidad, energía o temperatura infinita responsable de destruir el espacio y el tiempo, como en la antigua idea intuitiva del inicio en big bang de los universos de Friedmann-Lemaître. Pero no sabemos si esto es cierto en general; sigue siendo una pregunta abierta, aunque los infinitos en magnitudes físicas son una propiedad general de los universos en expansión dentro de una amplia gama de condiciones.

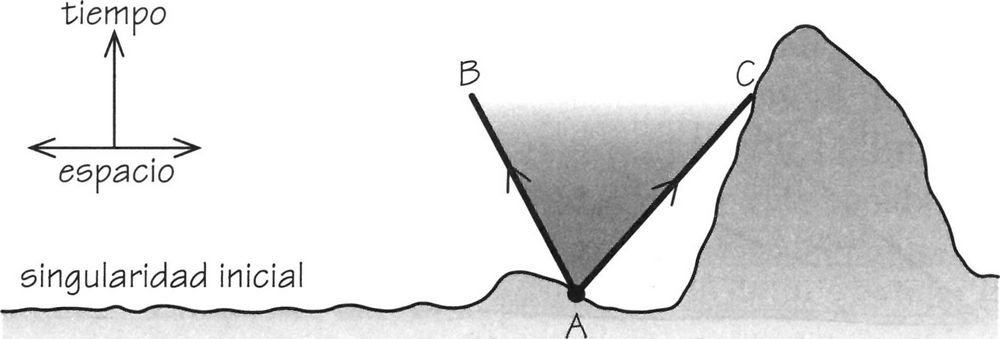

Las expectativas de nuestro sentido común acerca del principio del universo deben enfrentarse a otros cambios más sorprendentes. La singularidad no tiene por qué ser universal: no todas las historias pasadas tienen por qué tener un principio. Algunas de ellas pueden tenerlo, mientras que otras continúan eternamente hacia el pasado. E incluso aunque todas las historias posibles tuviesen un principio, no hay ninguna necesidad de que todas ellas empezasen simultáneamente. Y lo más espectacular: los astrónomos podrían observar los principios de algunas historias a continuación de otras historias que sucediesen en otros lugares (Figura 8.2).

¿Qué universos son singulares?

Qué objeto más curioso es la singularidad, con sus extrañas propiedades y su inexistente definición […] Algún día tendremos que asumir este problema.

Robert Geroch

Tras todas las confusiones e incertidumbres de decidir qué era una singularidad y si se podía evitar, a principios de la década de 1960 los cosmólogos aspiraban a encontrar una forma claramente definida de decidir esta cuestión para los universos en general, en lugar de limitarse a examinar las soluciones halladas una a una para averiguar si tenían un principio o una singularidad en el sentido de Misner. El matemático indio Amalkumar Raychaudhuri[274] había dado comienzo a este proceso de forma casi inadvertida en Calcuta en 1953; también fue el caso de Arthur Komar[275] en Estados Unidos en 1956. A ninguno de ellos les gustaba la idea de las singularidades, y Raychaudhuri, quizá por carecer de la influencia de las tradiciones cristianas heredadas, no pretendía que los universos tuvieran un principio. Aunque la densidad se hiciese infinita en algún momento del pasado, no veía necesidad alguna de que eso significase el principio del universo. Era posible continuar más allá del infinito en un camino aún desconocido hacia un estado anterior del universo. Lo más probable, pensaba él, era que las ecuaciones de Einstein simplemente no ofreciesen una descripción completa del universo cuando la densidad se hacía demasiado alta. Aparecerían nuevos términos en las ecuaciones de Einstein, las soluciones podían cambiar, y quizá desapareciesen las singularidades.

FIGURA 8.2. No es necesario que la singularidad inicial sea simultánea. El inicio anterior del universo en algunos lugares, como A, podría ser visible si se mira hacia la luz que llega de un lugar como C, con un inicio muy posterior. Las líneas AB y AC son trayectorias de rayos de luz que parten de A.

Esta era también la actitud de Einstein con las singularidades. Como Aristóteles 2000 años atrás, Einstein creía que en el universo no tenía que haber ningún infinito físico. Aquellos que apareciesen en las descripciones matemáticas debían ser efectos secundarios de una idealización incorrecta en la descripción del universo, o un fallo en las hipótesis en las que se basaba la teoría matemática que producía ese modelo.

De todos modos, a partir de las ecuaciones de Einstein, tanto Komar como Raychaudhuri mostraron que, en condiciones muy generales, habría momentos en el pasado en el que los universos asimétricos —pero sin rotación— sufriesen condiciones de infinita densidad, como los universos isótropos de Friedmann y Lemaître.

La exclusión de la rotación fue inoportuna, porque podía impedir que se desarrollasen densidades infinitas en la teoría de la gravedad de Newton. Pero esta laguna, junto con las antiguas ambigüedades sobre la generación de confusas singularidades por culpa de las coordenadas de representación, se resolvieron en 1965 con un dramático acontecimiento que proporcionó una nueva forma de mirar los universos.

Roger Penrose era un joven matemático puro que trabajaba en geometría algebraica; Dennis Sciama, colega investigador y amigo del hermano mayor de Roger, Oliver, lo indujo a reflexionar sobre la teoría de Einstein y el problema de las singularidades en los universos. Sciama había trabajado con Hoyle, Bondi y Gold en aspectos del universo de estado estacionario en la década de 1950, pero se había convertido rápidamente a la perspectiva del big bang tras el descubrimiento de la radiación de fondo de microondas en 1965.

Penrose utilizó su familiaridad con los métodos de matemática pura nunca antes utilizados en el estudio de universos para reflexionar sobre la cuestión de las singularidades de una forma totalmente nueva. En lugar de intentar demostrar que las ecuaciones de Einstein conllevaban densidades infinitas en el pasado, como Komar y Raychaudhuri, o de examinar una solución tras otra que describían universos diferentes, como Lifshitz y sus colaboradores, Penrose cambió de enfoque. A partir de la definición de singularidad introducida por Misner, se centró en las ecuaciones que describían la historia de partículas y rayos de luz. Demostró que al menos una de estas historias debía, en condiciones muy generales e independientemente de los detalles del universo, tener un principio.

Penrose creó el primer «teorema de la singularidad» de este revolucionario género en 1965; en él establecía la aparición de una singularidad en el interior de un agujero negro si una estrella de gran masa «muere» y se contrae bajo la fuerza de su propia gravedad[276]. En 1965 y 1966, Stephen Hawking, George Ellis y Robert Geroch utilizaron los métodos de Penrose para hacer lo mismo en universos enteros[277].

Esto dio lugar a la paulatina aparición de una delicada cuestión, ya que los cosmólogos intentaron ligar la antigua idea intuitiva del big bang y sus infinitos en magnitudes físicas, con la imagen matemática de una singularidad como historia que tiene un principio. Aunque en los universos más simples, como los de Friedmann, Lemaître, Kasner y Taub, era posible hacerlas cuadrar para mostrar que la causa de que la historia pasada no pudiera extenderse indefinidamente era la destrucción del espacio y el tiempo en un infinito físico, esto no era posible para todos los universos.

La avalancha de investigaciones matemáticas acabó generando un resultado muy potente, demostrado conjuntamente por Hawking y Penrose en 1970[278]. Su atractivo consistía en que, a pesar de la complejidad de sus matemáticas, sus supuestos podían en principio probarse mediante observaciones astronómicas. Mostraban que si:

- el espacio y el tiempo son lo bastante suaves (es decir, no empezamos insertando irregularidades que provocan la terminación de las historias);

- el viaje en el tiempo es imposible (de forma que no se puede evitar encontrarse con un principio al rastrear el pasado hacia atrás por el procedimiento de viajar hacia el futuro en un bucle temporal);

- hay suficiente materia y radiación en el universo (de forma que la fuerza de su atracción gravitatoria global es lo bastante grande);

- la gravedad es siempre una fuerza de atracción;

- la teoría de la relatividad general de Einstein es siempre verdadera,

entonces, hay al menos una historia en el espacio y el tiempo que debe haber tenido un principio.

Examinemos la lógica de esto. Se trata de un teorema, no de una teoría. Si los cinco supuestos son ciertos, la conclusión es necesariamente verdadera. Si uno o más de ellos falla[279], no significa que se pueda evitar un principio: solo quiere decir que ahora no tenemos teorema y la situación es indefinida. De hecho, cuando alguna de estas hipótesis falla, hallamos que podemos tener universos con singularidad o universos sin singularidad, sin principio[280].

La reacción a esas cinco condiciones fue diversa. Las dos primeras se consideraban, en general, perfectamente razonables: para la mayoría de personas, la existencia del viaje en el tiempo hacia el pasado sería peor que un universo con principio.

La certeza de la tercera podía ser comprobada por los astrónomos incluyendo el efecto gravitatorio de la energía de la radiación de fondo recientemente descubierta por Penzias y Wilson.

En aquel tiempo se creía que la cuarta hipótesis era verdadera. Era equivalente al requisito de que la presión p y la densidad ρ de materia del universo satisficiese en todo momento la condición:

ρ + 3p/c2 > 0 (*)

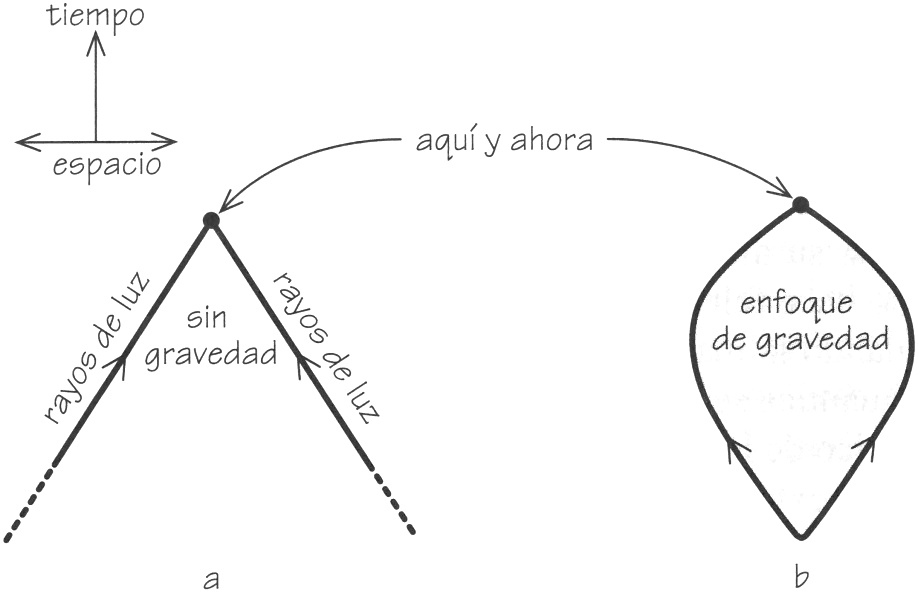

donde c es la velocidad de la luz. Por ejemplo, la radiación del cuerpo negro o térmica que constituye la radiación de fondo de microondas del universo —y es, de lejos, la forma predominante de radiación en el universo— tiene la propiedad de que ρ = 3p/c2 y, puesto que la densidad ρ es siempre positiva, la condición (*) se cumple para la radiación, y el efecto del campo gravitatorio que crea es atractivo (Figura 8.3). Desde que se demostraron esos teoremas hasta 1977 se creyó que la propiedad (*) era válida para todas las formas posibles de materia y que no había motivo para ponerla en duda, a menos que uno fuese una de esas personas que lo pone todo en duda.

La quinta condición era algo distinta: era posible que fallase. ¿Pero cómo y dónde? La teoría de la gravitación de Newton ejerció su dominio durante más de 200 años. Como hemos visto, acabó siendo reemplazada por la teoría de la relatividad general de Einstein. Pero ambas teorías se superponían considerablemente. Cuando la gravedad es débil y los objetos se mueven mucho más lentos que la luz, la teoría de Einstein se parece cada vez más a la de Newton en muchos aspectos. Pero la teoría de Einstein puede llegar allá donde no llega la de Newton. Cuando las velocidades se aproximan a las de la luz y la gravedad es lo bastante fuerte como para forzar movimientos a la velocidad de la luz[281], la teoría de Einstein sigue siendo válida y coherente donde la teoría de Newton falla.

FIGURA 8.3. (a) Trayectorias a través del espacio-tiempo que trazan los rayos de luz moviéndose a velocidad constante en ausencia de gravedad, (b) La atracción gravitatoria de la materia y radiación del universo dobla las trayectorias de los rayos de luz respecto de la línea recta. La gravedad los enfoca y convergerán en una singularidad en el pasado si hay materia suficiente en el universo y si la gravedad es siempre atractiva.

Si examinamos distintas situaciones extremas, es de esperar que la teoría de Einstein también acabe fallando. El descubrimiento de la naturaleza cuántica de la energía y de la materia por parte de Bohr, Einstein, Planck y Heisenberg durante el primer cuarto del siglo XX reveló que la energía viene en paquetes definidos y que no puede aceptar todos los valores posibles. Las tradicionales partículas de la física se muestran ahora con un aspecto ondulatorio complementario. Esta cualidad de onda tiene más en común con una oleada de crímenes que con una ola marina. Se trata de una onda de información. Del mismo modo que la llegada de una oleada de crímenes a tu barrio significa que es más probable que un crimen se haya cometido en él, que una onda de un electrón pase a través de tu instrumento significa que es más probable que detectes un electrón. La longitud de onda cuántica de una masa m es inversamente proporcional a m, de modo que cuando la masa es grande, los efectos de su onda cuántica son minúsculos, su alcance es mucho menor que el tamaño físico de la masa y no hace falta que les prestemos demasiada atención. Sin embargo, cuando la masa de una partícula es muy pequeña, su longitud de onda cuántica se hace mucho mayor y puede superar fácilmente el tamaño físico de la partícula. En esta situación, el comportamiento de la masa será extraño según los estándares de Newton: será intrínsecamente cuántico y ondulatorio.

La descripción de la gravedad de Einstein no contiene nada de estas rarezas cuánticas. Así, hace tiempo que nos hemos dado cuenta, después de que John A. Wheeler lo destacase en 1957, de que en las primeras fases del universo pudieron darse condiciones en las que la teoría de Einstein fallase. Necesitaríamos que una nueva versión de la relatividad general —la «gravedad cuántica»— ocupase su lugar. Para averiguar lo que vamos a necesitar consideraremos simplemente la distancia que la luz ha recorrido desde el inicio de la expansión (el tamaño del «universo visible») y nos preguntaremos si es inferior a la longitud de onda cuántica de la masa contenida en una esfera de ese radio (la masa de todo el universo en ese momento). Antes de ese momento, el comportamiento del universo entero será el de una onda cuántica que la teoría de Einstein es incapaz de describir: esta nueva era de gravedad cuántica, cuando la propia naturaleza del espacio y del tiempo es inestable, sucede cuando el universo tiene una edad de menos de 10−43 segundos.

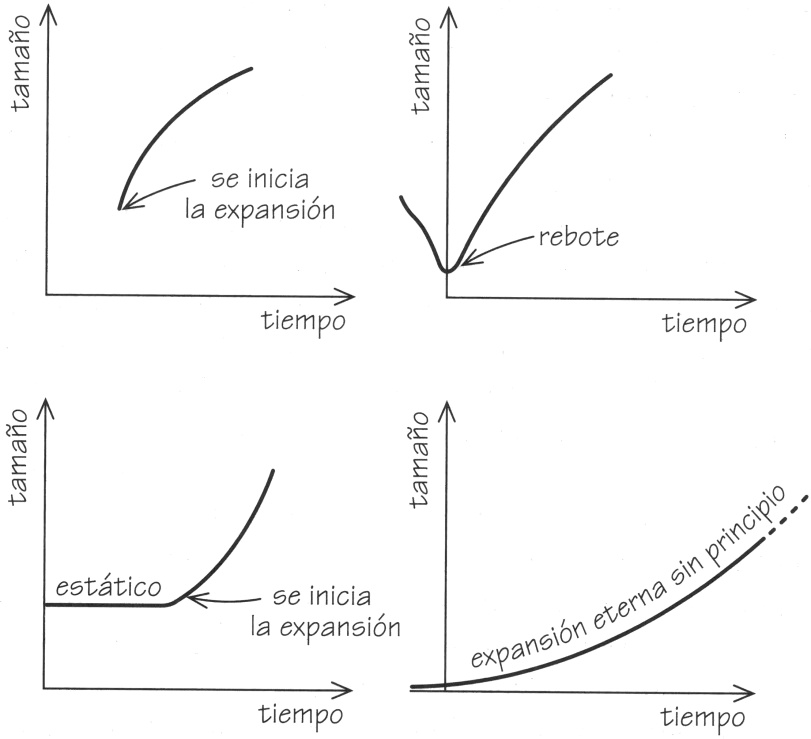

Supongamos que rastreamos nuestro universo en expansión hacia atrás en el tiempo hacia el tipo de inicio histórico que predice el teorema de la singularidad y suponemos que ocurre simultáneamente en todas partes en un momento pasado del tiempo que, por comodidad, etiquetamos como «t = 0». Sabemos que no podemos confiar en que la teoría de Einstein nos ofrezca una descripción completa de lo que sucede cuando nos acercamos mucho a t = 0. Nuestra expectativa es que la teoría falle cuando lleguemos hasta t = 10−43 segundos, un momento que se ha denominado tiempo de Planck, por el físico Max Planck[282]. El fracaso de la teoría puede hacer que cualquier teorema de este tipo no se pueda aplicar, bien porque el espacio y el tiempo dejan de ser suaves o porque los efectos gravitatorios cuánticos requeridos en ese momento provocan el fallo de la condición 4 del teorema de Hawking y Penrose. La gravedad podría hacerse atractiva y hacer que el universo «rebotase» hacia un estado de tamaño creciente en vez de seguir contrayéndose hacia una densidad cada vez mayor en el pasado. También se pueden imaginar otras alternativas simples (Figura 8.4). Todas ellas son coherentes con el comportamiento del universo en expansión que observamos en momentos posteriores. No podemos elegir una de ellas.

Esto recuerda bastante al antiguo escenario del universo cíclico propuesto por Richard Tolman en la década de 1930. Nuestro teorema de la singularidad significa que el universo no puede llegar hasta la singularidad y rebotar porque se espera que el espacio y el tiempo se destruyan en la singularidad: no se puede simplemente pasar por ella y cerrar los ojos ante la crisis de la teoría de Einstein. El rebote debe tener lugar cuando el universo llega hasta un tamaño muy pequeño, pero no cero, y esto exige que falle la condición 4 del teorema de singularidad.

A pesar del probable fallo de la relatividad general en las proximidades de la singularidad, entre 1966 y 1972 los cosmólogos seguían considerando que este teorema predecía la inevitabilidad de un período de densidad y temperatura inimaginablemente altas en el pasado. Incluso aunque el fallo de la teoría de Einstein impedía un evento de big bang de densidad infinita en el pasado, aún se esperaba que la densidad alcanzase un valor de 1094 veces la del agua, algo bastante singular se mire como se mire.

FIGURA 8.4. Algunos pasados hipotéticos en los que los universos no tienen singularidad y se expanden tal como se observa actualmente: (a) la expansión se inicia en un tiempo pasado finito, pero no en una singularidad de densidad infinita; (b) la expansión se inicia tras un «rebote» en una época de densidad finita que sigue a una fase de contracción; (c) la expansión se inicia tras un pasado eterno durante el cual el universo era estático; y (d) siempre hay expansión, que traza una curva exponencial que nunca llega a tamaño cero en cualquier tiempo finito pasado.

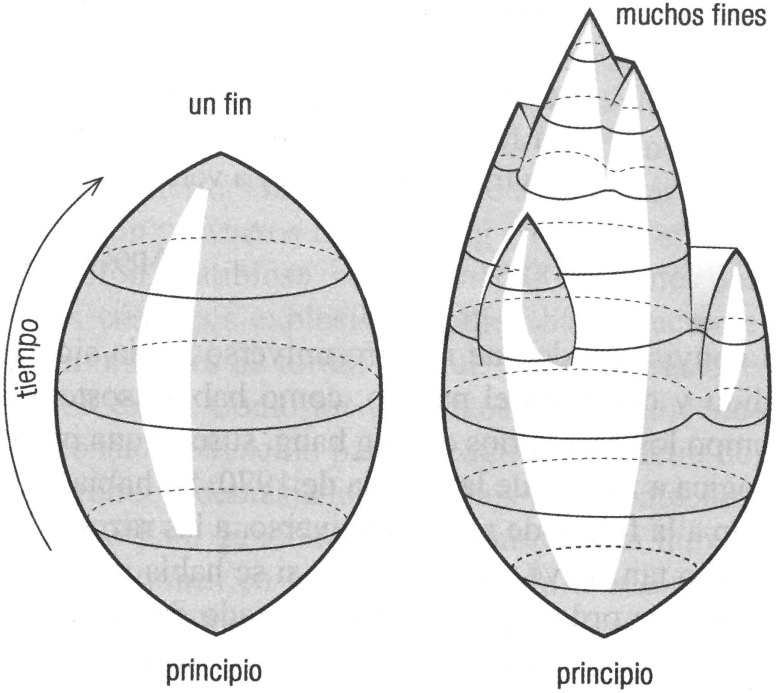

Hasta ahora hemos hablado de que esta singularidad tuvo lugar en el pasado, pero también puede estar aguardándonos en el futuro si vivimos en uno de esos universos «cerrados» hallados por primera vez por Friedmann, cuya expansión acaba por invertirse y convertirse en contracción. Al acercamos a esta singularidad final, inevitablemente el universo será cada vez más irregular, porque las irregularidades crecen con el paso del tiempo. Se formarán agujeros negros, que luego se fusionarán entre sí. Algunas partes del universo sufrirán un big crunch antes que otras (Figura 8.5). Quizá algunos observadores puedan incluso ver cómo otras regiones sufren el crunch mucho antes que ellos. ¿Ocurre este big crunch —el fin de todo— en todas partes en momentos distintos? ¿Qué significa eso? De hecho, ¿qué significa «fin»? ¿Y qué quiere decir «todo»? No es únicamente el principio del universo lo que plantea preguntas incómodas y sin respuesta.

FIGURA 8.5. (a) Solo en un universo cerrado perfectamente suave será simultánea la singularidad final; (b) pero en un universo realista, donde algunas regiones son más densas que otras, las regiones más densas llegarán a la singularidad final antes que las menos densas. Un encuentro temprano con la singularidad en un lugar del universo podría ser observable desde otros lugares.

La singularidad en el pasado plantea su propia lista de cuestiones metacientíficas acerca de lo que sucedió «antes». ¿Qué es lo que determina cómo es el universo cuando emerge de la singularidad? Si el espacio y el tiempo no existían antes de la singularidad, ¿qué sucede con las leyes de la física? ¿Existían antes de la singularidad? ¿Cómo se pueden aplicar los métodos habituales de la ciencia a un evento único como la singularidad?

Estas eran algunas de las preguntas insólitas que suscitaban estos estudios sobre el principio del universo. Los cosmólogos se centraron en asuntos más específicos en los que parecía posible hallar respuestas. ¿Podía demostrarse que las historias pasadas finitas siempre llegaban a un final en el que la densidad y la temperatura eran infinitas, como cuando extrapolamos el modelo de nuestro universo en expansión hacia atrás en el tiempo? La gran pregunta era la siguiente: ¿debemos creer que las hipótesis del teorema de la singularidad se cumplen en la Naturaleza? Si la respuesta es afirmativa, debemos creer que hubo una singularidad en el pasado. En caso contrario, habrá que replanteárselo todo.

Universos fríos y tibios

Conozco tus obras: no eres ni frío ni caliente. ¡Ojalá fueras frío o caliente! Pero porque eres tibio y no frío o caliente, voy a vomitarte de mi boca.

Apocalipsis 3:15[283]

La nueva convicción de que nuestro universo había sido fantásticamente cálido y denso en el pasado, como habían sostenido durante mucho tiempo los partidarios del big bang, suscitó una nueva pregunta cosmológica a finales de la década de 1970. Se había prestado mucha atención a la forma de nuestro universo, a las razones por las que se había hecho tan suave e isótropo y a si se había iniciado en un estado de caos o de orden, pero se había dejado de lado una cuestión: ¿de qué estaba hecho? El descubrimiento de la radiación de fondo térmica había creado una nueva constante de la Naturaleza: el número de fotones por protón (o por átomo) en el universo. Este número era muy grande, alrededor de mil millones[284].

Si igualáramos toda la materia del universo, de modo que en lugar de estrellas y planetas solo hubiese una formación de átomos individuales regularmente espaciados, solo habría alrededor de un átomo por metro cúbico de espacio. Esta densidad es extraordinariamente baja, mucho más que la de cualquier vacío artificial que se pudiera crear en cualquier laboratorio de la tierra. En el mismo volumen habría aproximadamente mil millones de fotones de la radiación de fondo cósmica. Así que la proporción aproximada de mil millones a uno es una medida del contenido relativo de radiación térmica del universo. El valor de mil millones es muy grande, mucho más del que puede generarse mediante explosiones de estrellas u otros procesos violentos que tienen lugar en el universo actual, y fue una de las razones por las que fue tan difícil hallar una explicación para la existencia de esta radiación de fondo en el universo de estado estacionario. Sin embargo, la teoría del big bang aún tenía que explicar por qué había mil millones de fotones por átomo, y no muchos más o muchos menos.

Pronto se comprendió que esta cifra jugaba un rol crucial en la historia de un universo de big bang caliente, ya que determinaba cuándo las condiciones serían lo bastante frías como para que se formasen átomos, y luego estrellas y galaxias, y cuál sería su tamaño al formarse. Pero la razón de la cifra de mil millones de fotones por átomo siguió siendo un misterio. Hubo intentos de determinar si se podía haber empezado con universos de big bang fríos, con solo unos pocos fotones por protón, o «tibios», con unos 10 000 fotones por protón, y ver si eventos cósmicos explosivos podían haber incrementado esa cifra hasta mil millones de forma natural[285]. Por desgracia, esos intentos no tuvieron éxito. Como los universos turbulentos antes, no podían proporcionar explicación para la cantidad de helio del universo —tendían a producir demasiado— y todos los acontecimientos violentos necesarios para generar la radiación térmica hubiesen dejado reveladoras variaciones en la temperatura de la radiación de fondo más allá del límite de una parte por millar establecido por los astrónomos. Los universos calientes debían empezar ya calientes.

Un universo inesperadamente más simple

Durante los cinco actos interpretó al rey como si tuviese un pánico pasajero de que alguien fuese a sacar un as en cualquier momento.

Eugene Field, crítico teatral[286]

Uno de los subproductos de estas investigaciones fue hacerse preguntas más inquisitivas acerca de las partículas elementales que poblaron las primeras etapas del universo del big bang. Era una cuestión que había impulsado por primera vez Lemaître, pero a la que no había podido dar respuesta. Luego, Alpher y Herman, con James Folin, habían dado los primeros pasos hacia la incorporación de lo que se sabía sobre física de altas temperaturas al universo del big bang[287].

Quizá pensases que los cosmólogos no tenían más remedio que formar equipo con los físicos nucleares y de partículas para poder averiguar el aspecto del universo en su juventud. Sin embargo, antes de 1973 la física de altas energías no servía, sorprendentemente, de mucha ayuda. La razón era simple: no existía descripción funcional alguna de lo que sucedía con la materia por encima de los 100 000 millones de grados, mucho más allá de cualquier temperatura alcanzable en cualquier experimento en la Tierra. Por desgracia, a los teóricos no les iba mucho mejor. Todos sus intentos de crear una teoría de partículas elementales altamente interactivas acababan por predecir que sus interacciones debían simplemente hacerse cada vez más fuertes conforme aumentaban las energías. Las cosas no tardaban en convertirse en un batiburrillo intratable donde no había forma de efectuar cálculos con un mínimo de fiabilidad[288]. Parecía el fin de la posibilidad de comprender las primeras fases del universo. Estábamos condenados a ver cómo todo se complicaba cada vez más a medida que retrocedíamos más y más. El denominado «principio» del universo, o la singularidad del teorema de Hawking y Penrose, parecía estar más allá de nuestra capacidad de comprender las leyes de la Naturaleza.

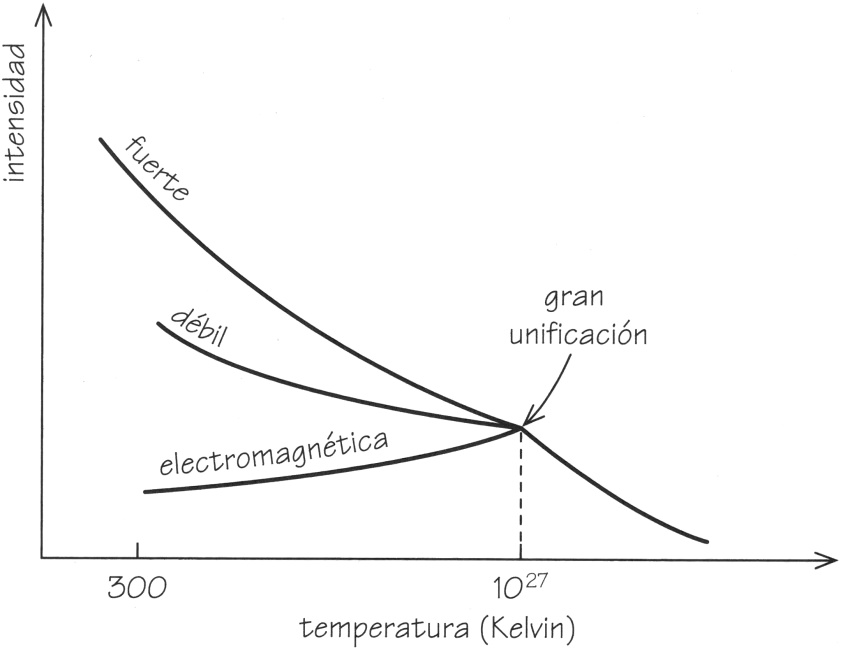

En 1973 emergió una nueva y revolucionaria teoría sobre el comportamiento de las partículas elementales en altas energías, gracias al trabajo de David Politzer, David Gross, Frank Wilczek, Tony Zee y Gerardus t’Hooft. Esta teoría trastornó por completo nuestras antiguas ideas sobre lo que sucede en las interacciones entre partículas de materia a altas energías. El mar de energía en el vacío cuántico que nos rodea tiene efecto sobre las propiedades de las partículas elementales que se mueven en él. En consecuencia, la intensidad de las interacciones entre las partículas cambia a medida que se incrementa la temperatura del entorno. Si se coloca una partícula con carga eléctrica, como un electrón, en un vacío cuántico atraerá las partículas con carga opuesta de entre las que fugazmente aparecen y desaparecen tomando energía prestada del vacío cuántico. Una partícula con carga negativa queda entonces rodeada por un escudo de cargas opuestas. Otro electrón que se aproxime lentamente, como se muestra en la Figura 8.6a, no será repelido por la carga negativa completa del electrón, sino solo por la carga menor, debilitada por el escudo. Por otro lado, un electrón con más energía, como el mostrado en la Figura 8.6b, penetrará en la nube del escudo y sentirá una mayor proporción de la carga negativa desnuda contenida en él.

FIGURA 8.6. (a) Un electrón que se acerca, B, con una energía baja, se dispersa débilmente debido al blindaje de cargas eléctricas positivas virtuales alrededor de la carga negativa central del electrón objetivo, A. (b) Un electrón que se acerque con una energía alta penetrará la nube de cargas positivas y se verá sometido a una fuerza de repulsión sin protección mayor por parte del electrón objetivo.

Esto significa que la fuerza de la interacción percibida depende de la energía del entorno en el que tiene lugar dicha interacción. Para partículas como electrones, que participan en interacciones electromagnéticas, la intensidad efectiva de la fuerza que perciben aumenta a medida que se incrementa la energía del entorno a causa del vacío cuántico. En el caso de la interacción fuerte entre partículas elementales como quarks y gluones, el efecto del vacío cuántico es totalmente inesperado: hace que las interacciones fuertes se hagan más débiles al incrementarse la energía del entorno. Este descubrimiento, que valió un premio Nobel, se conoce como «libertad asintótica», porque sugiere que, en las energías más altas posibles, las partículas se comportarían como si estuviesen completamente libres de toda interacción. También liberó a los cosmólogos del yugo de la antigua forma de concebir las partículas elementales. De pronto, el principio del universo tenía un aspecto más simple.

Y una forma unificada de pensar

One is one and all alone

And evermore shall be so.

(Uno es uno y uno solo

y siempre será así)

«Green Grow the Rushes O»[289]

En unos pocos años, estos espectaculares descubrimientos teóricos alteraron el curso de la física de partículas. El cambio en la fuerza efectiva de las interacciones entre partículas con el incremento de la energía y de la temperatura ofrecía una solución nueva a un viejo enigma: ¿cómo podía existir una teoría unificada de todas las fuerzas de la Naturaleza cuando sus intensidades son tan dispares? Superficialmente, las fuerzas fuerte y débil tenían un aspecto totalmente distinto. No solo tenían intensidades desiguales, sino que actuaban sobre distintas poblaciones de partículas.

El incremento en la intensidad efectiva de las fuerzas más débiles, como el electromagnetismo y la radiactividad, junto con el debilitamiento de la fuerza fuerte, podía producir una triple intersección a una energía muy alta en donde las intensidades efectivas de las fuerzas del electromagnetismo y la radiactividad y la fuerza fuerte entre partículas nucleares serían iguales. La idea de una «Gran Teoría Unificada» (o GUT, por sus iniciales en inglés) de estas tres fuerzas fundamentales nació cuando, en 1975, Howard Georgi y Sheldon Glashow fundaron la primera (y más simple) candidata a convertirse en esa teoría (Figura 8.7[290]).

FIGURA 8.7. El efecto de las fluctuaciones del vacío en la intensidad efectiva de la fuerza electromagnética, fuerte y débil predice que las intensidades convergerán a una energía muy alta y que podrá ocurrir una «gran unificación» de estas tres fuerzas de la Naturaleza. A bajas energías del universo actual, sus intensidades son muy diferentes.

Todo esto cambió la perspectiva de los cosmólogos y estableció una nueva y distinta dirección en el estudio del universo. De repente, la cuestión de comprender el comportamiento de la materia y la energía en los instantes cada vez más próximos al principio a fin de reconstruir el pasado del universo ya no era un problema completamente intratable, condenado a empeorar cuanto más retrocediésemos. La libertad asintótica implicaba que la interacción se haría cada vez más débil y las cosas cada vez más simples (o, al menos, no más complicadas) a medida que mirábamos hacia atrás a las altas temperaturas que debían haber existido cerca del inicio de la expansión del universo. El resultado fue que el estudio de los universos empezó a cambiar. Antes se había puesto mucho interés en la geometría de los universos, examinando los diferentes tipos de expansión posibles, explorando si podían evolucionar y convertirse en el universo que vemos actualmente, e intentando comprender cómo había surgido el universo a partir de una singularidad en el pasado. A veces, los físicos de partículas se interesaban de forma pasajera por estas discusiones, pero eran escasos los que se implicaban seriamente en ellas. Una vez que la libertad asintótica permitió hacer afirmaciones creíbles sobre el comportamiento de la materia a temperaturas muy altas, cada vez más físicos de partículas empezaron a converger hacia la cosmología. El entorno del universo joven ofrecía un nuevo lugar en el que resolver las consecuencias de sus teorías y extraer sus consecuencias observacionales.

La interacción entre el estudio del universo —lo muy grande— y las partículas más elementales de la materia —lo muy pequeño— funcionaba en ambas direcciones. Los físicos de partículas querían comprobar sus nuevas teorías para ver si sus consecuencias astronómicas eran buenas o malas. Los cosmólogos empezaron a interesarse por las singulares propiedades de las teorías de la física de altas energías para ver si podían arrojar un poco de luz en algunos desconcertantes problemas sobre el universo. ¿Podía la materia no luminosa del espacio estar compuesta de nuevos tipos de partículas elementales? ¿Por qué el universo observado se compone de materia y no de antimateria?

Este tipo de preguntas podían replantearse a la luz de una nueva comprensión de la materia en el cálido universo de los inicios. Con ello comprendieron que algunas cantidades, como el equilibrio cósmico entre materia y antimateria, no están fijadas de forma inmutable. Y de ese nuevo espíritu indagador surgirían gran cantidad de universos nuevos con sorpresas tanto para el físico de partículas como para el astrónomo.