4

Las matemáticas de la metabiología

Paseos aleatorios en el espacio del

software

Tal como hemos visto en los dos capítulos anteriores, la vida como software en evolución es una buena metáfora. Pero ¿es un enfoque productivo desde un punto de vista matemático? He aquí la clave de la cuestión. Yo creo que lo es, porque su empleo nos permite demostrar que la evolución funciona de un modo bastante simple y natural, lo cual explicaré a continuación…

Pero antes de lanzarnos a una formulación matemática de la metabiología, quiero preparar el terreno. Quiero explicar cómo actúan las matemáticas puras, cómo funcionan, qué podemos esperar de ellas, lo que le permitirá contemplar mi modelo simplificado de la evolución con empatía en lugar de compasión.

Comenzaremos con dos citas, una de un matemático magnífico con una variedad de intereses nada habitual, mi amigo fallecido Jacob («Jack») Schwartz, y otra de un biólogo teórico, el inspirador John Maynard Smith. Para consultar el texto completo sobre las limitaciones del método matemático que extraje del sugerente ensayo de Jack titulado «The Pernicious Influence of Mathematics on Science» (La perniciosa influencia de las matemáticas en la ciencia), consúltese el apartado de las tres citas aparentemente contradictorias con que comienza este libro. Aquí basta recordar que

la técnica matemática sólo puede llegar lejos si parte de un punto cercano a los elementos esenciales de un problema que posea tales elementos esenciales (Jacob Schwartz).

Una observación elocuente, puesto que proviene de alguien que ha trabajado en numerosas áreas de las matemáticas puras y aplicadas.

Es más, he aquí lo que dice Maynard Smith sobre los modelos matemáticos en biología:

Puede parecer natural pensar que para comprender un sistema complejo debemos construir un modelo que incorpore todo lo que sabemos acerca del sistema. Por sensato que pueda parecer este procedimiento, en biología ha resultado ser, repetidas veces, un ejercicio estéril. Hay dos problemas al respecto. El primero es que el modelo acaba siendo tan complicado que no es posible comprenderlo; la gracia del modelo está en la simplificación, y no en la confusión. El segundo es que si se construye un modelo lo bastante complejo se puede conseguir que haga lo que uno quiera jugando con los parámetros; un modelo que puede predecirlo todo no predice nada (John Maynard Smith y Eörs Szathmáry, Ocho hitos de la evolución[7]).

Además, la metabiología está en ciertos aspectos más próxima a la física teórica que a las matemáticas puras. Y, en la física teórica, los denominados toy models, muy simplificados, forman parte del juego de herramientas habitual, de la metodología estándar. Se confía en que capten las características esenciales de una situación.

He aquí otro modo de expresarlo: queremos encontrar la situación más simple, la más sencilla desde un punto de vista matemático que nos permita demostrar que la vida evoluciona, el sistema mínimo que encaje con la definición de vida que se da en la obra Los problemas de la biología de John Maynard Smith. O, dicho de otro modo, ¡aspiramos a encontrar la forma de vida matemática más simple!

Y, por supuesto, no perseguimos simulaciones por ordenador de un realismo extremo, con un alto grado de detalle de los sistemas vivos, eso que se denomina «biología de sistemas» y que se ha convertido en una disciplina nueva y muy popular.

Asimismo haría algunas observaciones sobre el arte de desarrollar una teoría matemática, observaciones que tal vez no resulten absolutamente obvias a quienes no se han pasado la vida haciendo matemáticas, componiendo matemáticas, inmersos en el mundo de las ideas matemáticas…

Las matemáticas no son el arte de responder interrogantes matemáticos (la mayoría de ellos no se pueden resolver o tienen soluciones feas, embrolladas, poco interesantes). Las matemáticas son más bien el arte de formular las preguntas adecuadas, las cuestiones que tienen respuestas bellas, fértiles, sugerentes.

Y las matemáticas no son una herramienta práctica, una vía para encontrar respuestas. Para ello, use una máquina, ¡use una computadora! Las matemáticas son un arte, ¡una vía de acceso al conocimiento! El propósito de una demostración no consiste en determinar si algo es verdad, ¡sino en decimos por qué es verdad, en permitirnos saber lo que está ocurriendo, lo que está pasando!

¡Pero basta ya de consideraciones metodológicas! ¿Cómo funciona en realidad mi modelo de la evolución? A continuación indico un resumen de las ideas esenciales que ahora intentaré explicar.

IDEAS ESENCIALES DE LA METABIOLOGÍA

- Vida = software en evolución aleatoria

- Un solo organismo de software O, ¡un matemático!

- Creatividad biológica = creatividad matemática

- Capacidad adaptativa de O = problema del castor hacendoso = tamaño de la salida

- Expresión de los números grandes: N, N + N, N x N, NN, NNN N veces…

- Evolución = escalada a una cumbre en un paseo aleatorio O, O’, O’’ …

- Mutaciones algorítmicas O’ = M1(O), O’’ = M2(O’)…

- Probabilidad de mutación algorítmica de K bits, M = 2−K

- Oráculos no algorítmicos eliminan malas mutaciones M

- ¡La capacidad adaptativa de O aumenta más deprisa que cualquier función computable!

- ¡De modo que la evolución es creativa, no mecánica!

Pasemos ahora a presentar nuestro modelo simplificado de la evolución.

He aquí la idea matemática clave: nuestros organismos son matemáticos, y nosotros detectamos la creatividad matemática y biológica. Nuestro modelo es lo bastante abstracto para que en él no haya diferencias esenciales entre la creatividad matemática y la biológica.

Para que nuestro organismo siga evolucionando, para evitar que se estanque, para impedir un punto fijo, tenemos que desafiarlo, tenemos que encomendarle una tarea difícil, algo que pueda absorber una cantidad ilimitada de creatividad matemática. Para hacerlo aprovechamos la incompletitud de Gödel (1931), en una variante relacionada con el famoso problema de la parada de Turing (1936), a saber, el problema del castor hacendoso, que es el problema relacionado con la expresión de números enteros extremadamente grandes y sin signo.

El problema del castor hacendoso lo inventó Tibor Radó a los sesenta y tantos años de edad, tal como contamos en Gödel’s Way (El estilo de Gödel), la obra que escribí junto con Da Costa y Doria. La referencia original es: T. Radó, «On Non-Computable Functions» (Sobre funciones no computables), Bell System Technical Journal, 41 (mayo de 1962), págs. 877-884.

La cuestión anterior se puede reformular de manera no técnica si se aprovecha la observación de Feyerabend en Tratado contra el método de que en ciencia no hay métodos absolutamente generales, afirmación que en matemáticas es un teorema, la refutación del sueño de Hilbert por parte de Gödel (1931) y Turing (1936). Tal como señala Feyerabend, no hay métodos generales, puesto que siempre se precisa creatividad; no existe ningún modo mecánico para hacer ciencia y en consecuencia ¡la evolución no se estancará!

Mi modelo elimina la física y elimina el cuerpo y da como resultado una formulación matemática lo bastante simple para permitimos entender qué sucede y demostrar teoremas. Asimismo, no me ocupo del origen de la vida; parto de seres vivos en pleno funcionamiento, y los hago evolucionar sin fin. También suprimo poblaciones y suprimo el sexo; ¡Sólo tengo un único organismo! ¡Y aun así evoluciona! ¡No hace falta mucho para que ocurra la evolución! Y eso es bueno porque significa que la evolución es muy básica, ¡muy robusta!

Ahora llegamos al núcleo matemático de nuestro modelo metabiológico de la evolución. Esto resultará un poco técnico, un tanto árido. Haremos una dura escalada, pero procuraré explicar lo mejor que pueda todo lo necesario y no sólo con fórmulas, sino también con palabras. Pero, si no consigue entender algo, por favor, páselo por alto y continúe adelante y ascendiendo. Limítese a contemplar la panorámica general e intente hacerse una idea global de lo que estoy haciendo.

De modo que tenemos un único organismo de software, un programa informático que llamaremos P, y lo que nos interesa es saber el número más alto que P es capaz de calcular. Cuanto mayor sea ese número, mejor adaptado está P. Vamos a hacer cambios aleatorios en P y en cada instante hay un solo organismo P, de modo que P ejecuta lo que se denomina un paseo aleatorio en espacio de software, que es el espacio de todos los organismos posibles de software, todos los programas posibles P.

Imagine a una persona ebria que deambula dando tumbos; es una manera más pintoresca de describir un paseo aleatorio, el paseo de un beodo. Pero nuestros organismos P no son borrachos, sino entregados matemáticos que trabajan con empeño en el problema del castor hacendoso, el problema de calcular un número entero muy, muy grande.

Técnicamente estamos buscando una clase especial de paseo aleatorio, uno que recibe el nombre de paseo aleatorio «en escalada». ¿Por qué? Pues porque como no deambulamos de manera completamente aleatoria, la capacidad adaptativa tiene que ir siempre en aumento. Intentamos que P mute aleatoriamente hasta que al fin calcule un número mayor. El experto estadounidense en genética de poblaciones Sewall Wright dio un nombre llamativo a esta clase de proceso: lo describió en términos del llamado paisaje adaptativo. Si pensamos en el paisaje consistente en la capacidad adaptativa de cada organismo posible, siempre estamos ascendiendo, una estrategia bien conocida en muchos algoritmos de optimización.

He aquí cómo funciona nuestro paseo aleatorio en escalada: intentamos conseguir una mutación aleatoria, la usamos para transformar nuestro organismo actual. Si el organismo resultante calcula un número más alto, si está mejor adaptado, entonces reemplaza al organismo actual. En caso contrario conservamos el organismo actual y probamos otra mutación aleatoria, y así sucesivamente.

Y la cuestión clave es la siguiente: ¿a qué velocidad crece la capacidad adaptativa (= el tamaño del número que se calcula)?

Así que éste es nuestro paseo aleatorio, y en él sólo hay un organismo en proceso de mutación. Pero no hemos terminado aún. También tengo que contarle cómo seleccionar las mutaciones y con qué probabilidades.

El paso crucial para lograr que la metabiología funcione matemáticamente consiste en permitir mutaciones algorítmicas: si una mutación M es un programa de K bits que toma el organismo original A como entrada y produce el organismo mutado A’ = M(A) como salida, entonces esta mutación M tiene una probabilidad 2−K. En otras palabras, si M es una función de K bits, una transformación que se pueda describir en K bits, entonces tiene una probabilidad de 1/2K.

Y en nuestro modelo de paseo aleatorio hay un concepto asociado de distancia, que se mide en bits. Un organismo A dista K bits de otro organismo B si la probabilidad de que nuestro paseo aleatorio nos lleve de A a B en un solo paso asciende a 1/2K. O, expresado de un modo más formal, la distancia mutacional entre los organismos A y B se define como

−log2 de la probabilidad de ir de A a B con una única mutación.

Pues resulta que éste es también el tamaño en bits del programa M más pequeño que toma A como entrada y produce B como salida, lo que en mi especialidad anterior, la teoría algorítmica de la información, se denomina «la complejidad de longitud de programa» de la función más simple M con B = M(A), también conocido como el «contenido relativo de información» de B, dado A. Comento esto porque la equivalencia entre la manera probabilística y de longitud de programa para definir la distancia mutacional es uno de los teoremas fundamentales de mi artículo de 1975 aparecido en Journal of the Association for Computing Machinery, el cual presentó por primera vez en todo su esplendor el formalismo correcto para la teoría algorítmica de la información.

En otras palabras, la distancia mutacional es la cantidad de información algorítmica que se necesita para pasar de A a B, para obtener B a partir de A, para transformar A en B. Y nótese, por favor, que siempre es posible pasar de A a B con un solo paso. En otras palabras, la distancia mutacional siempre es finita, la probabilidad de mutar de A a B en un único paso siempre es mayor que cero.

Ahora tengo que hablarle sobre el oráculo, que es de donde procede en realidad toda la creatividad de nuestro modelo. «¿Qué oráculo?», preguntará usted. Sí, se encuentra un poco escondido, pero está en el modelo que acabo de describir.

Antes de nada debo contarle qué es un oráculo. Se trata de otra idea divertida de Alan Turing, pero no procede de su famoso artículo de 1936, sino de un artículo menos conocido de 1939. Un oráculo es un procedimiento que nos permite calcular algo que no se puede calcular usando una computadora normal. En particular, nos puede brindar un método para decidir si un programa informático se detendrá en algún momento. Esto se denomina «oráculo para el problema de la parada».

En otras palabras, es una fantasía matemática. Es una manera de imaginar computadoras más potentes de lo que podrían llegar a ser las computadoras reales.

Y ¿por qué necesitamos un oráculo para el problema de la parada?

Lo necesitamos para evitar organismos que no funcionan y mutaciones que no funcionan. Esto es, organismos que nunca producen un número entero como salida, y mutaciones M que cuando se aplican a un organismo A nunca producen un organismo mutado B = M(A). No existe ningún algoritmo para lograr esto (se trata del irresoluble problema de la parada de Turing), así que necesitamos que un oráculo nos diga cuándo saltarse una mutación o un organismo que nunca se detiene.

De modo que éstas son las reglas del juego, así es como funciona nuestro paseo aleatorio en escalada. Pero ¿con qué rapidez evoluciona?

Usaremos la denominada «función del castor hacendoso» (BB)[8] para medir el ritmo de la creatividad biológica = la velocidad de evolución. BB(N) se define como el número entero más grande que se puede expresar en N bits = el número entero más alto generado como salida por cualquier programa de longitud ≤ N bits que produzca un único entero y después se detenga = la capacidad adaptativa de nuestro organismo de software mejor adaptado y de longitud ≤ N bits.

En otras palabras, queremos conocer a qué velocidad crece la capacidad adaptativa. Y resulta que aumenta muy deprisa, de modo que tenemos que emplear algo bien conocido que crezca muy deprisa para comparar, que nos sirva como calibración. Y, tal como observó Tibor Radó, BB(N) crece más rápido que cualquier función computable de N, más deprisa que N elevado a N elevado a N, etcétera. N-factorial veces, por ejemplo. A la larga excederá cualquier función computable. A partir de cierto punto siempre será mayor. Usaremos BB(N) para caracterizar el ritmo de la creatividad biológica en nuestro modelo evolutivo.

¿Y por qué ponemos tanto énfasis en la creatividad? ¿Por qué es tan importante la creatividad? ¡Pues porque nuestros parásitos, competidores y predadores también evolucionan! Es una carrera de armamentos, tal como expresa la «hipótesis de la Reina de Corazones» de Leigh Van Valen: tienes que correr lo más deprisa que puedas para mantenerte en el mismo sitio (¡Van Valen tuvo que fundar una revista nueva para poder publicar esta hipótesis!). Los genes no quieren ser egoístas, tal como afirma Dawkins en su libro El gen egoísta; ¡quieren evolucionar! Ésta es la razón de que haya sexo, que no es egoísta en absoluto: ¡con el sexo nos desprendemos directamente de la mitad de nuestro genoma! ¿Llamarías egoísta a alguien que se desprende de la mitad de su dinero? El sexo no es egoísta; incrementa la creatividad.

Aparte de fundar una revista para poder publicar al fin su artículo más célebre, Van Valen, que falleció en 2010, también se negó a aceptar becas de investigación (para preservar su libertad y creatividad) y ¡otorgaba calificaciones más altas a los estudiantes que discrepaban de él! ¡Verdaderamente creía en la creatividad!

La «hipótesis de la Reina de Corazones» de Van Valen explica por qué hay tanta creatividad en la biosfera terrestre. Pero, en mi modelo metabiológico, ésta emerge por sí sola a partir de las reglas del juego: no hay parásitos, ni competidores, ni predadores; lo único que hay es un solo organismo cada vez.

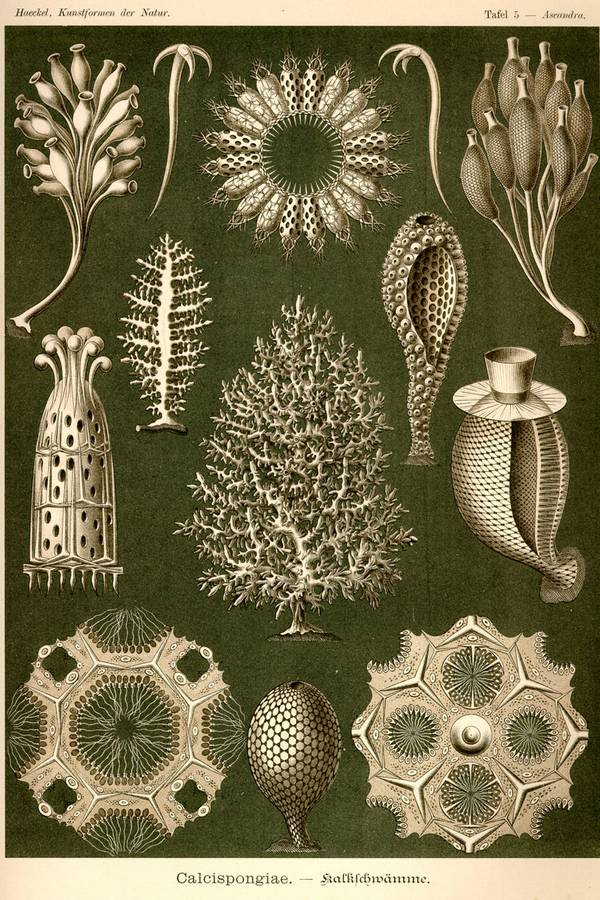

Para ahondar en la exuberante creatividad de la naturaleza, recomiendo mirar, por supuesto, los hermosos libros de Ernst Haeckel dedicados al arte biológico. En nuestro libro exhibimos esos trabajos al comienzo de cada capítulo.

Pero sí me quedo con el énfasis que pone Dawkins en los genes. ¿Quién cuida del cuerpo? Es también la idea fundamental del análisis de la vida que realiza Maynard Smith: el fuego tiene un metabolismo y se reproduce, pero no evoluciona. La vida es un sistema con herencia y mutaciones, y evoluciona mediante selección natural. Las llamas no tienen herencia, no transmiten información genética, no recuerdan cómo empezaron a existir, de modo que no pueden evolucionar, lo cual es toda una suerte porque si no ¡nos veríamos acosados por gigantescos fuegos depredadores inteligentes! Compare usted esto con mis organismos, que tienen ADN pero no cuerpo ni metabolismo.

Nos acercamos al meollo de la cuestión. Ahora estamos en condiciones de comparar tres sistemas evolutivos radicalmente distintos: la búsqueda exhaustiva irreflexiva, la evolución aleatoria acumulativa, y lo que yo denomino el «diseño inteligente».

Para hacernos una idea de lo bien que funciona la evolución darwiniana en nuestro modelo de castor hacendoso, necesitamos acotarlo por arriba y por abajo. De ese modo veremos en qué medida real es inteligente, creativa o aleatoria la evolución.

He aquí lo que dicen las matemáticas:

- • El diseño inteligente: actúa lo mejor posible seleccionando mutaciones sucesivas para proceder del mejor modo posible, no al azar; alcanza la capacidad adaptativa BB(N) en un tiempo N.

- • La búsqueda exhaustiva irreflexiva: explora todos los organismos posibles al azar, es decir, no tiene en cuenta el organismo previo; alcanza la capacidad adaptativa BB(N) en un tiempo 2N; y

- • La evolución aleatoria acumulativa: es la evolución darwiniana real y explora todas las mutaciones algorítmicas posibles al azar; alcanza la capacidad adaptativa BB(N) en un tiempo intermedio entre N2 y N3.

Así que, como ve, la evolución aleatoria acumulativa se acerca mucho más al diseño inteligente que a la búsqueda exhaustiva irreflexiva, ya que N2 y N3 se acercan más a N que a 2N. Éste es nuestro hauptsatz, nuestro teorema principal o fundamental, y por esta razón afirmamos que nuestro modelo evoluciona y que, por tanto, está vivo.

Tal como proclamaría orgulloso ahora un matemático puro, QED, quod erat demonstrandum, lo que se pretendía demostrar. ¡El azar es creativo! Las mutaciones aleatorias y la selección natural, ¡alcanzan una suerte de inteligencia! ¡La inteligencia surge de manera espontánea!

Más arriba hablo de tiempo, pero ¿cómo se mide éste en mi modelo? Veamos,

tiempo = número de mutaciones que se exploran = número de pasos efectuados en el paseo aleatorio.

Por supuesto, no todas esas mutaciones tienen éxito, pero las contamos todas.

¿Cómo funciona todo esto? ¿Cómo demuestro estas estimaciones? Bueno, en nuestro modelo simplificado de la evolución de castor hacendoso resulta que los organismos que evolucionan suponen aproximaciones cada vez mejores a la probabilidad de detención Ω (con cotas cada vez más bajas, de hecho), porque ésos son los organismos mejor adaptados. Y el diseño inteligente obtiene N bits de Ω en un tiempo N, que es lo mejor posible; la búsqueda exhaustiva, que se atasca intentándolo todo, obtiene N bits de Ω en un tiempo 2N y la evolución acumulativa aleatoria obtiene N bits de Ω en un tiempo situado entre N2 y N3.

¿Recuerda el capítulo anterior? En él sostuve que es creatividad matemática concentrada. En otras palabras, tenemos, respectivamente, N bits de creatividad en un tiempo N, y N bits de creatividad en un tiempo 2N, y por último N bits de creatividad en un tiempo situado entre N2 y N3.

No explicaré más la demostración aquí, pero sí lo haré en el próximo capítulo, que se corresponde con una conferencia que di en el Instituto de Santa Fe. El público lector con conocimientos de matemáticas o de física debería consultar también el segundo apéndice, que incluye algunos detalles adicionales.

Estas tres estimaciones quizá no le parezcan mucho a los no matemáticos. Pero he dedicado cuarenta años (desde 1969, consúltese la larga lista de mis publicaciones que hacen mención a la biología) a encontrar una manera de estudiar la evolución con este grado de generalidad matemática, y nunca había conseguido llegar ni a la primera base. Esto tal vez no parezca mucho (de hecho no es más que el primer paso hacia una teoría matemática general, abstracta, de la evolución y la creatividad biológica), pero ese primer paso suele ser el más difícil. Lo difícil es alcanzar los conceptos que establecen las cuestiones fundamentales y que se pueden tratar matemáticamente.

Así que estoy esperanzado al respecto. Sí, al principio me sentí un tanto eufórico, pero ahora el sentimiento general es de esperanza contenida. El tiempo dirá. Confieso que estos resultados me parecen un tanto extraños incluso a mí. Al fin y al cabo, son flamantes, es una disciplina nueva. Llevará algún tiempo dilucidar si estamos equivocados o si realmente hay algo ahí. Algún tipo de modelo de software en evolución tendría que funcionar, creo yo.

Ahora, quisiera preparar el ambiente para la conferencia que di en el Instituto de Santa Fe, la cual fue, por decirlo así, el debut mundial oficial de la metabiología. Fue un entorno muy estimulante. El Instituto de Santa Fe, una estructura similar a un monasterio zen de espléndidas y amplias vistas suspendida a 2000 metros de altitud sobre el nivel del mar en pleno desierto de Nuevo México y rodeada de nieve bañada por una luz solar radiante. La audiencia era perfecta: un grupo selecto de físicos, matemáticos y científicos expertos en computación interesados en sistemas complejos. He aquí lo que les conté; por cierto, esto sucedió meses atrás, cuando aún no había descubierto Los problemas de la biología, el libro que Maynard Smith publicó en 1986.